谷歌新HBM芯片突破2PB:内存瓶颈有望缓解

AI 需求激增,内存价格上涨趋势难逆转

过去一年,内存价格经历了3-5倍的显著增长,这一趋势已对个人电脑和智能手机的市场消费意愿产生了不容忽视的影响。分析指出,驱动此次内存价格飙升的“罪魁祸首”正是日益强劲的人工智能(AI)需求。

AI技术对内存的容量和带宽提出了极高的要求,尤其是在图形处理单元(GPU)上作为显存的部分。谷歌近期发布的第八代张量处理单元(TPU)v8,便是这一需求的直观体现。

TPU v8 的架构升级与内存容量激增

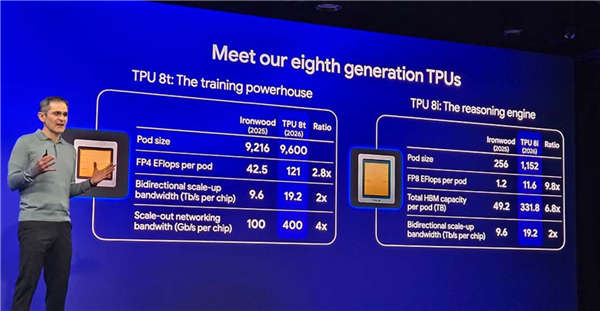

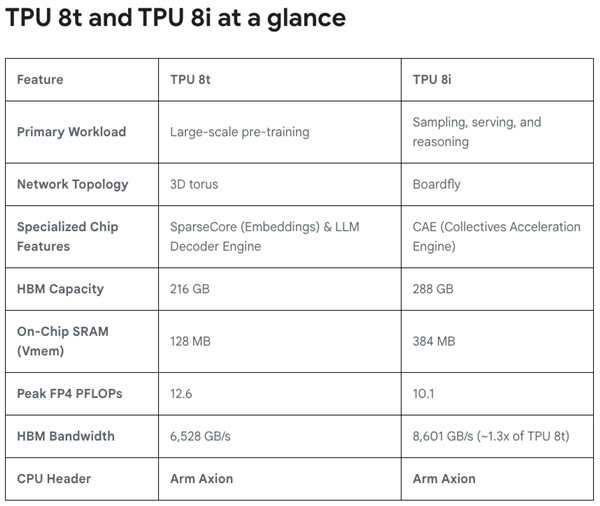

今年推出的TPU v8在设计上首次区分了训练和推理负载。其中,V8T专注于AI训练任务,虽然也支持推理,但其主要定位是训练。据介绍,每个Pod节点集成了9600个V8T芯片,FP4性能高达121EFlops,内存带宽达到19.2TB/s,芯片内部带宽更是高达400GB/s,相较于前代产品,多项参数实现了2-4倍的提升。

而面向AI推理负载的V8i,其规格有所调整。每个节点配置1152个V8i芯片,算力降至11.6EFlops,但内存带宽依旧保持在19.2TB/s。

此次TPU v8设计中最引人注目的变化是内存容量的显著增加。V8i节点配备了高达331.8TB的HBM(高带宽内存),而V8T更是达到了惊人的2PB HBM内存。具体到每个V8T芯片,则配备了216GB HBM内存。

“内存墙”的突破与行业影响

谷歌此次的设计理念旨在突破AI发展中的“内存墙”。2PB HBM内存的配置不仅在于其总容量的庞大,更在于其在一个节点内被视为单一全局地址使用。与此前的NVIDIA GPU通过NVLink等技术实现PB级HBM内存堆叠不同,传统的连接方式仍需经过数据中心网络,易受性能和延迟瓶颈的制约。

RobustCloud首席顾问Larry Carvalho认为,谷歌此举标志着其在AI芯片领域可能面临重大的竞争转变。

然而,对于普通消费者而言,谷歌此次大规模采用2PB HBM内存并非利好消息。这预示着AI对内存的需求将持续攀升。值得注意的是,HBM内存通常需要消耗常规DDR内存2-4倍的DRAM芯片产能。HBM用量的增加,必然会挤占DDR内存的产能。

尽管需求高涨,但三星、SK海力士、美光等主要内存制造商此前已明确表示不会大幅提升芯片产能,而是会优先保证HBM的供应。在此背景下,内存芯片的紧缺状态预计将进一步加剧,价格的回落短期内难以实现。

谷歌TPU v8对2PB HBM的引入,无疑是AI算力发展道路上的一座里程碑,但同时也将加剧全球内存市场的供需失衡,预示着消费者在未来一段时间内仍将面对高昂的内存价格。