视觉智能范式革新:CVPR2026预示技术新纪元

计算机视觉领域正经历一场深刻的范式转变,研究重点已从单纯提升机器的“看”的能力,转向让视觉信息成为驱动推理、决策与交互的强大媒介。

告别“盲目推理”,走向自适应与隐式路径

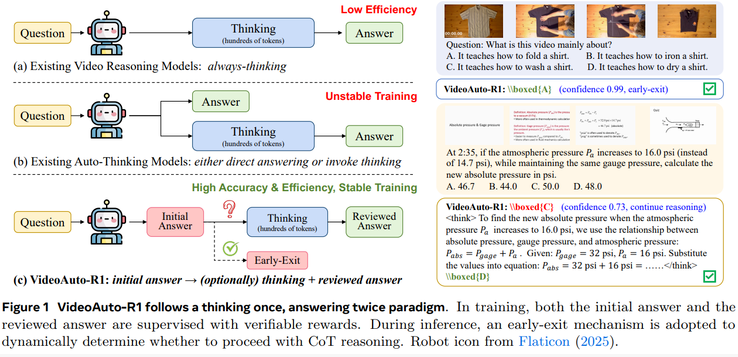

过往多模态模型普遍采用“思维链”(CoT)进行逻辑推理,但最新研究表明,这种“每一次都推理”的模式效率低下。例如,VideoAuto-R1框架提出的“按需推理”机制,能够区分简单感知任务与复杂逻辑场景,前者直接给出答案,后者才触发推理。实验数据显示,这一方法在保持顶尖性能的同时,显著降低了平均输出长度约3.3倍,提升了效率。

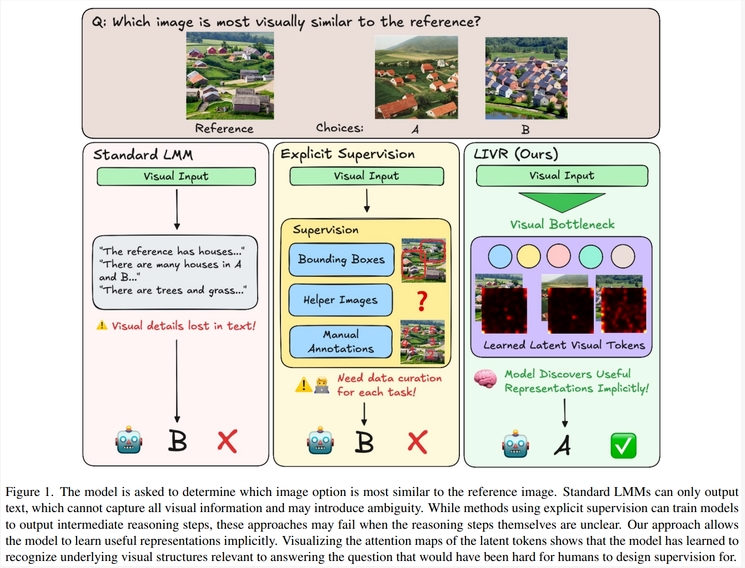

此外,模型的推理方式也在发生演变。过去,模型高度依赖语言来理解和处理空间关系,在应对拼图或几何结构等任务时显得力不从心。当前趋势是将推理过程转移至“潜在空间”,模型可以直接在低维度的向量表示中进行隐式视觉推理,无需将其转化为线性的文本描述,从而更自然、高效地处理复杂的视觉结构。

评测体系反思:打破“选择题”的虚假繁荣

现有视觉语言模型评测多采用多项选择题(MCQA),这种方式存在系统性高估模型能力的风险。研究指出,模型可能通过排除法或选项偏差等“投机取巧”的方式,导致真实得分被虚高约20个百分点。为了解决这一问题,业界正积极推动“可验证开放问答”的评测范式,要求模型必须真正理解视觉内容,而非依赖选项线索来作答。

同时,评测场景已从单一主体、静态图像扩展至多智能体环境。VS-Bench等新兴基准的出现,要求模型不仅要理解环境本身,还要具备在合作、竞争等复杂交互场景下的策略推理和决策能力,这标志着视觉智能正从单纯的“理解者”向“决策者”进化。

基础设施升级:开源模型与真实数据补全

在模型形态上,开源社区正朝着更彻底的透明度迈进。Molmo2等模型不仅开放了权重,还完整公开了训练数据和流程。这些模型的能力已从处理单幅图像扩展至视频,并引入了精细的定位功能,实现了从“看懂”到“指出具体位置”的质的飞跃。

支撑这些技术进步的是日益完善的数据基础设施。针对文本驱动的图像编辑任务,Pico-Banana-400K等大规模真实数据集的推出,有效弥补了此前过度依赖合成数据的不足。该数据集支持多轮编辑和偏好对齐,为训练更具常识和逻辑的编辑模型奠定了坚实基础。

总而言之,视觉智能正从单一的感知能力,演进为融合感知、认知与行动的一体化智能系统。这一转变并非简单的性能微调,而是推理机制、评测范式和数据供给等多个维度的系统性重构。

新一代视觉智能模型正朝着更高效、更真实的推理能力迈进,未来有望在人机交互、复杂场景理解和智能决策等领域发挥更广泛的应用价值。