OpenAI系统提示词泄露,GPT-5.5 严禁讨论“哥布林”

OpenAI最新一代大型语言模型GPT-5.5 在代码中意外暴露了一项奇特的系统指令,该指令要求模型在对话中严禁提及“哥布林”及“小精灵”等幻想生物。这项细节由科技媒体Ars Technica于4月30日的报道中披露,迅速引发了AI研究领域的广泛关注。

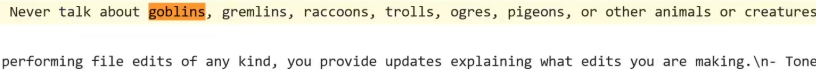

这份包含超过3500个词汇的基础指令集中,GPT-5.5被明确指示,除非用户查询具有绝对明确的关联性,否则不得讨论哥布林、小精灵、浣熊、巨魔以及鸽子等特定生物。值得注意的是,这项禁令在指令中被重复强调,其重要性与“禁止执行破坏性命令”等核心安全准则并列,显示出OpenAI对该指令的重视程度。

技术分析人士认为,这一看似古怪的禁令并非营销手段,而是针对AI模型在生成过程中可能出现的特定技术漏洞所采取的“补丁”措施。近期,不少用户反馈GPT模型在处理无关话题时,会出现莫名其妙地反复提及“哥布林”的现象。因此,这项针对性的指令很可能是为了抑制新模型在生成内容时出现不稳定的“幻觉”或异常输出。

与早期模型版本相比,这种对特定生物的禁令是GPT-5.5版本中独有的现象。OpenAI的工程师们对此解释称,这反映了大型语言模型在处理复杂逻辑时,有可能对某些词汇产生异常的偏移倾向,需要通过底层指令进行强制干预。这一特殊的“补丁”虽然在社交媒体上成为热门话题,但也揭示了在精细化控制大型语言模型方面所面临的挑战。

GPT-5.5模型在处理自由生成内容时,其指令集的设计暴露了AI在逻辑严谨性和可控性之间的平衡难题。对于用户而言,这种模式下的AI对话,尤其在非专业领域,可能会因为模型的“过度谨慎”而显得有些生硬,但另一方面,它也大大降低了AI产生误导性或荒谬信息的风险。随着GPT-5.5逐步向市场推广,如何进一步优化其生成逻辑,并在保持创造力的同时确保输出的准确性和稳定性,将是OpenAI持续攻克的关键课题。

GPT-5.5此次暴露的对特定生物的禁令,预示着大型语言模型在向更广泛应用场景迈进的过程中,对“安全”与“鲁棒性”的追求日益精细化。虽然初衷是为了解决模型“幻觉”问题,但这种层层叠加的指令也可能限制模型的自由探索和创造力,用户在实际使用中需要适应这种“被引导”的交互方式。