DeepSeek API 输入缓存降价至原价一成

DeepSeek 巨幅下调 API 价格,国产大模型迎来成本新纪元

AI 领域的国产领军者 DeepSeek 近期宣布了一项重大的价格调整策略,将其全系 API 的输入缓存命中价格大幅削减至最初发布价格的十分之一。此举预示着国内人工智能成本控制迈入了崭新的阶段,旨在通过提供极具吸引力的性价比,吸引更广泛的开发者和企业群体拥抱和使用其先进的模型服务。

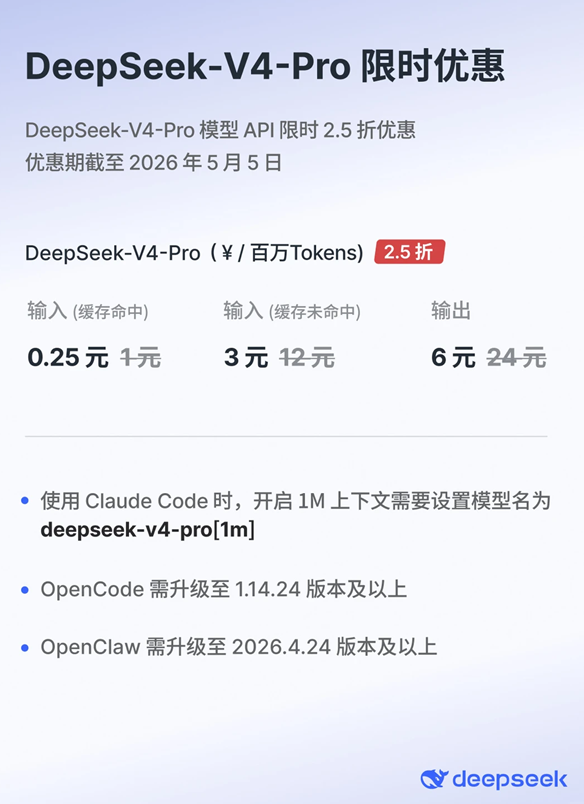

此次价格调整的核心在于显著降低了开发者在使用 API 时的成本。具体而言,V4-Pro 和 V4-Flash 全系列模型都包含在内。其中,V4-Pro 的缓存输入价格已降至每百万 Tokens 仅需0.1元,若再叠加限时优惠,实际支付价格更是低至0.025元。相较于海外的顶级竞品,其缓存输入价格仅为 GPT-5.5Pro 的七百分之一,展现了强大的市场竞争力和对成本优势的极致追求。

不仅是缓存命中场景,API 的未命中场景及输出价格也同步进行了下调,降幅均达到了原价的四分之一。这样的定价策略具有高度的针对性,特别关注了如 RAG 知识库构建、智能客服系统以及文档分析等需要高频调用的应用场景。DeepSeek 的此次调整预计能为企业用户在这些高频应用中节省超过90%的运营成本,极大地促进了 AI 技术在商业领域的落地和普及。

DeepSeek 能够实现如此大幅度的价格下调,其背后是自主研发的稀疏注意力架构技术。这项创新技术不仅支持处理高达160k token 的超长上下文,显著提升了长文本的处理效率,更重要的是,它有效降低了底层所需的计算资源消耗以及数据存储成本,从而为价格的激进下调奠定了坚实的技术基础。

DeepSeek 的大模型服务目前已与包括华为云、阿里云在内的八大主流云平台实现了深度整合与适配。业内普遍认为,DeepSeek 的这一举措将对当前的大模型行业定价体系产生深远影响,甚至可能迫使海外模型厂商调整其市场策略。长远来看,这将加速人工智能应用从实验室研究阶段快速走向大规模商业化普及,惠及更广泛的社会经济领域。

DeepSeek此次API价格的大幅下调,对于开发者而言降低了AI应用开发的门槛,尤其是在需要处理大量文本数据的场景下,显著提升了成本效益。其高效的稀疏注意力架构和对长上下文的支持,意味着无论是进行复杂的文本分析、构建强大的知识库,还是优化智能对话体验,都将变得更加可行和经济,有望进一步推动AI技术的民主化进程。