锐龙Max+ 395本地部署DeepSeek V4模型

DeepSeek V4 深度评测:1.6万亿参数模型如何实现本地部署与高效表现

备受瞩目的 DeepSeek V4 模型在4月24日发布了预览版,并迅速开源,一举登顶开源大模型排行榜。这款模型凭借其庞大的1.6万亿参数量,在AI领域掀起了新的波澜。尽管其整体参数惊人,但通过极致的稀疏化设计,实际激活参数仅为490亿,这在算力成本与长文本处理(token成本)之间取得了巧妙的平衡。

在核心能力方面,DeepSeek V4 Pro 版本在编程和数学解题方面表现出与更大参数量闭源模型相媲美的水平。更具吸引力的是其 V4 Flash 版本,为用户提供了极具竞争力的成本优势:百万 token 输入费用低至0.02元,输出也仅需2元;而 V4 Pro 版本的输入价格为0.025元,输出价格为6元。这意味着百万超长上下文处理已成为官方服务的标配,不再是额外昂贵的增值选项。

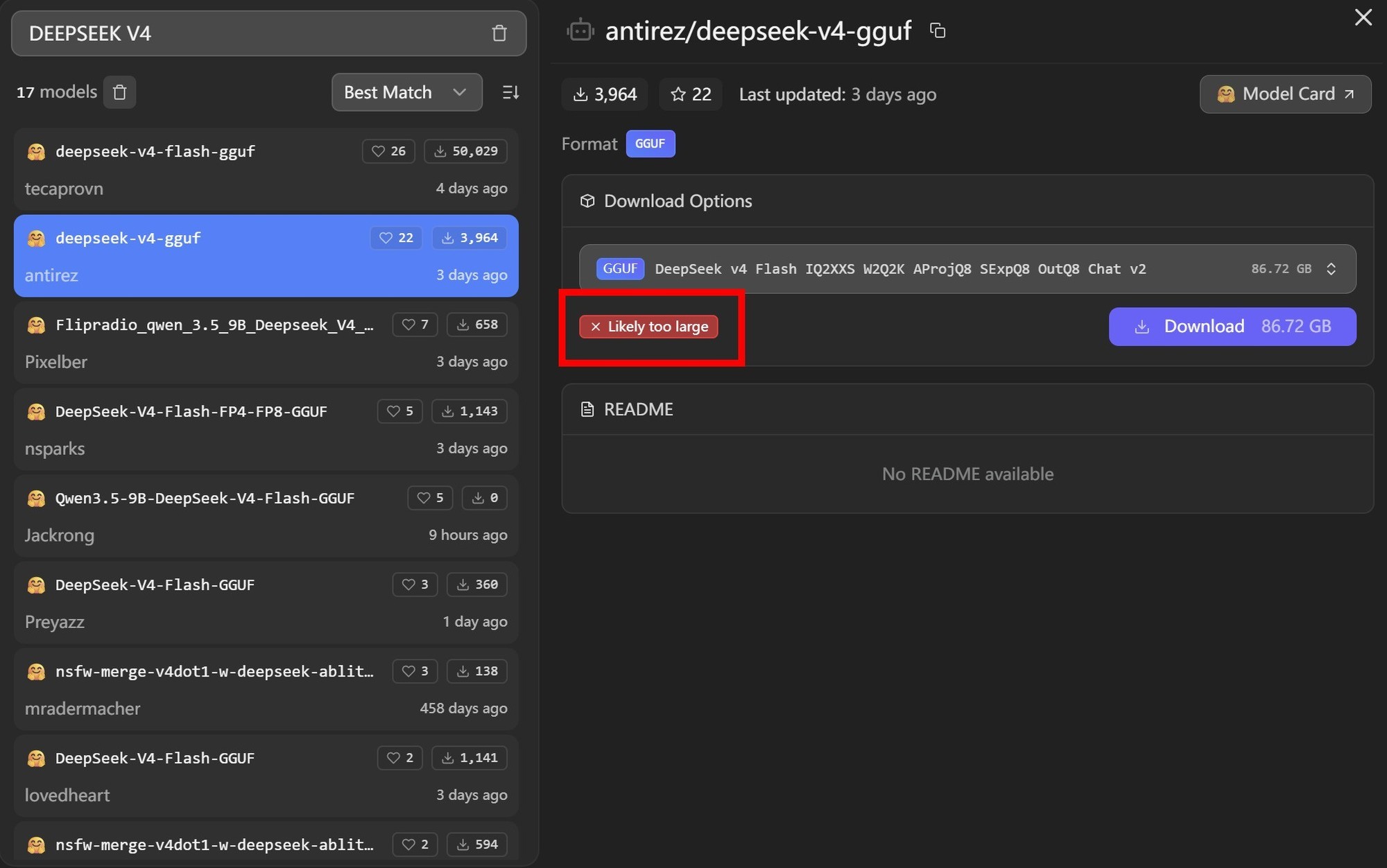

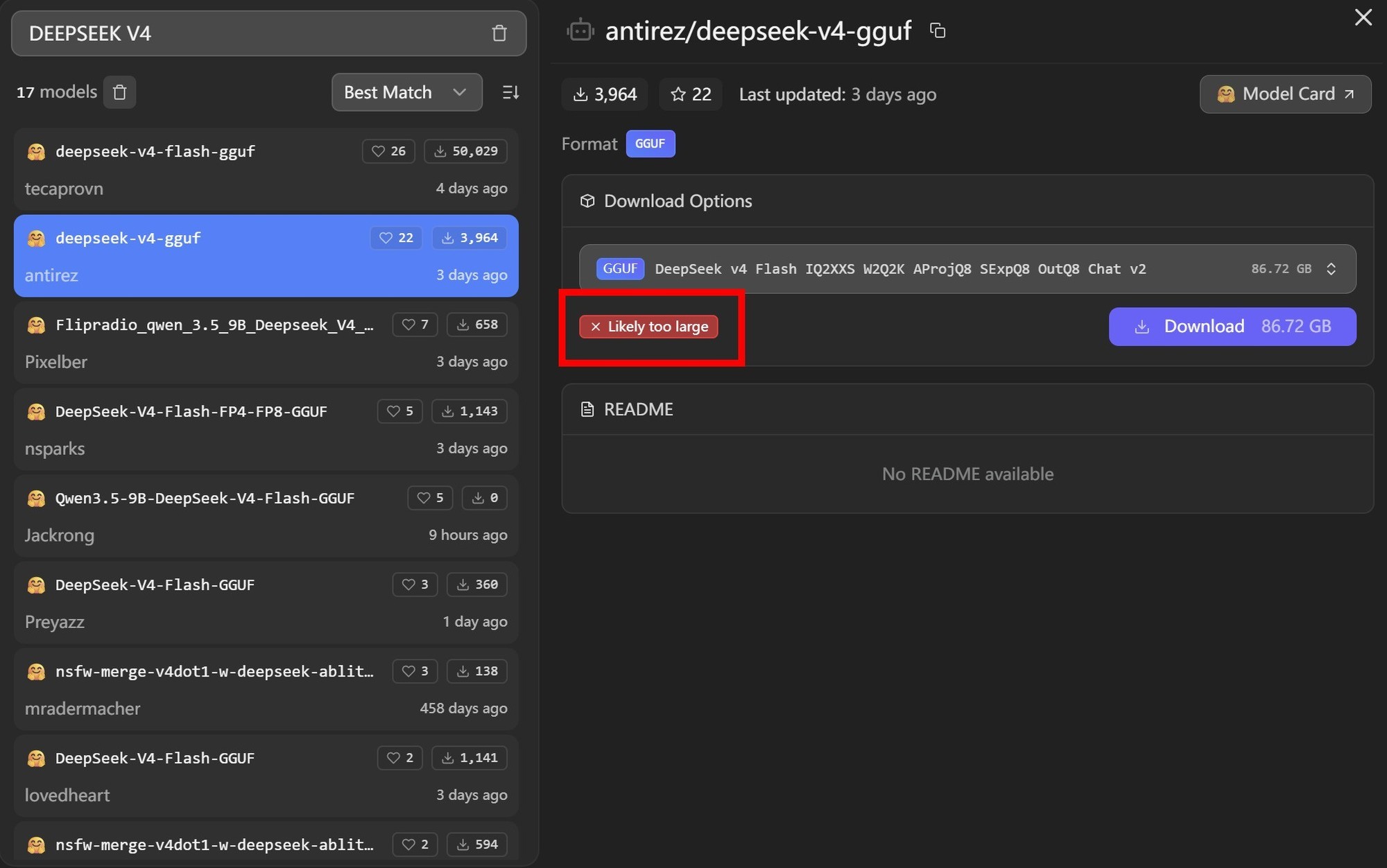

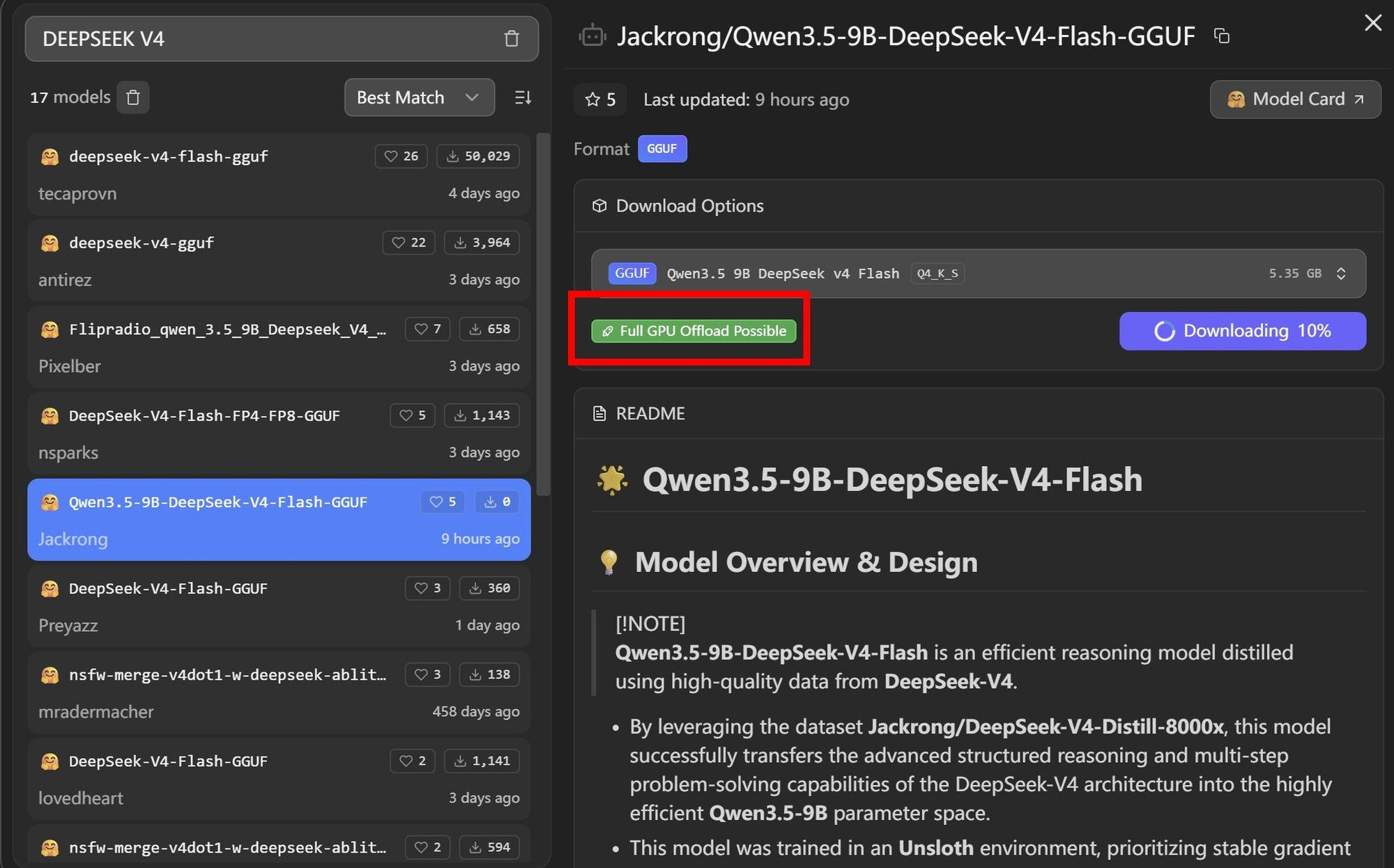

对于普通用户而言,本地部署和使用 DeepSeek V4 成为可能。通过 LM Studio 或 Ollama 等工具,即可在本地环境中运行。然而,考虑到原始模型参数量巨大,对硬件要求极高,直接运行可能超出大多数个人用户的能力范围。因此,针对个人用户,推荐使用基于 Qwen 3.5-9B 架构,并经过 DeepSeek V4 蒸馏优化后的 Flash 版本。这款仅9B参数量的蒸馏模型,在保证性能的同时,大幅降低了硬件门槛,使其更易于在消费级硬件上流畅运行。

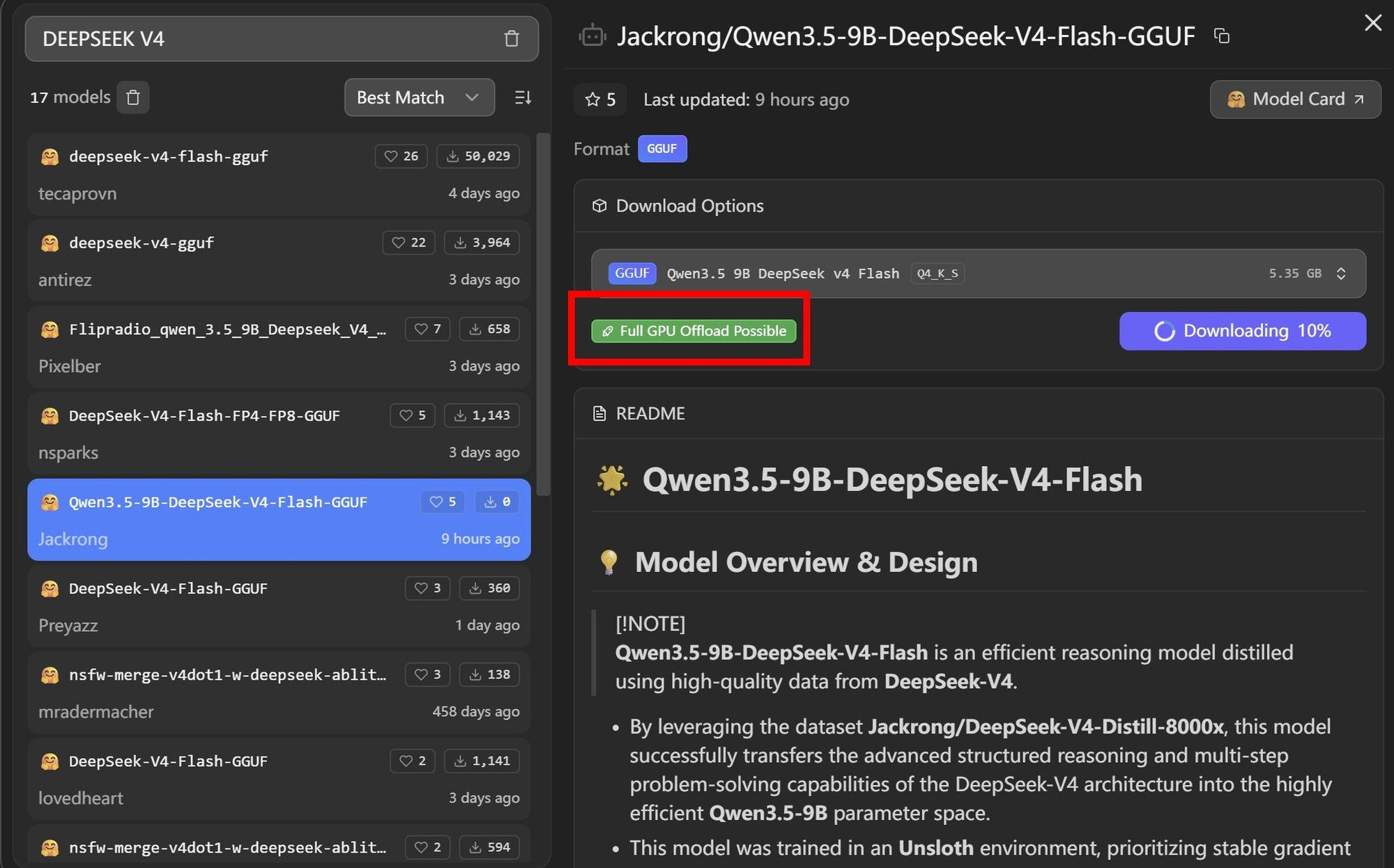

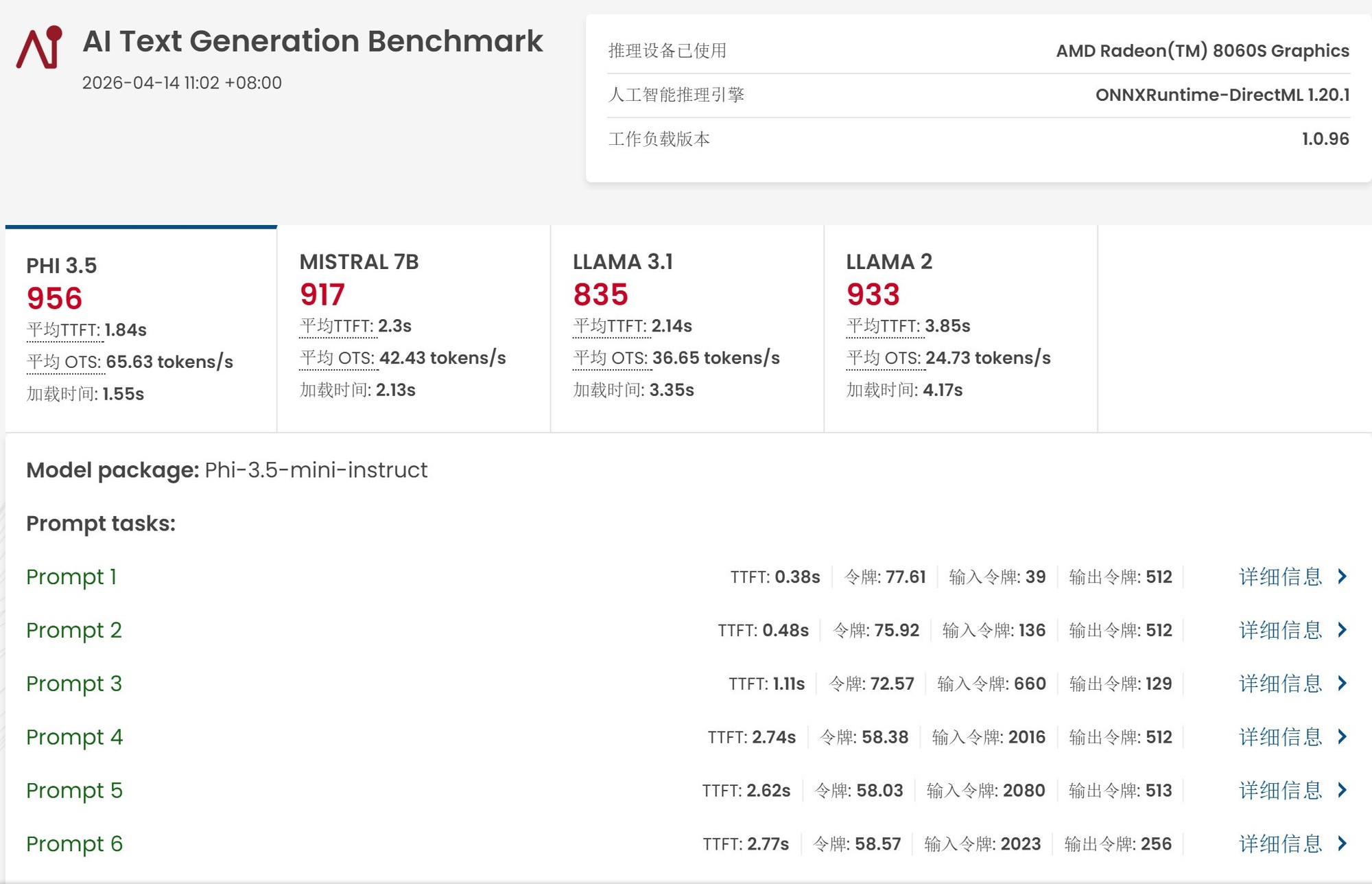

为了验证这款蒸馏模型的实际表现,我们在一台搭载 AMD 锐龙 AI Max+ 395 处理器(64GB统一内存)、Radeon 8060S GPU 和 1TB PCIe 4.0 固态硬盘的平台上,对 Qwen 3.5-9B-DeepSeek V4-Flash 版本进行了部署和测试。在进行 DeepSeek V4 的性能评估前,我们首先通过 UL Procyon 大语言模型基准测试,对一些常见大模型的推理速度进行了对比。结果显示,PHI 3.5 的生成速度达到了 65.63 tokens/s,MISTRAL 7B 为 42.43 tokens/s,Llama 3.1 为 36.65 tokens/s,而 Llama 2 为 24.73 tokens/s。这表明在本地部署小型参数量大模型方面,现有硬件已能提供轻松流畅的体验。此外,该平台也成功支持了 GPT-OSS-20B、DeepSeek-R1-14B 等其他大型模型的本地推理。

在实际运行 Qwen 3.5-9B-DeepSeek V4-Flash 模型时,我们使用了 Q4_K_S 量化,其内存占用约在 18.6GB 左右,GPU 的占用率也接近 90%,显示出模型对硬件资源有一定程度的调用。

核心评测维度:编程与数学能力

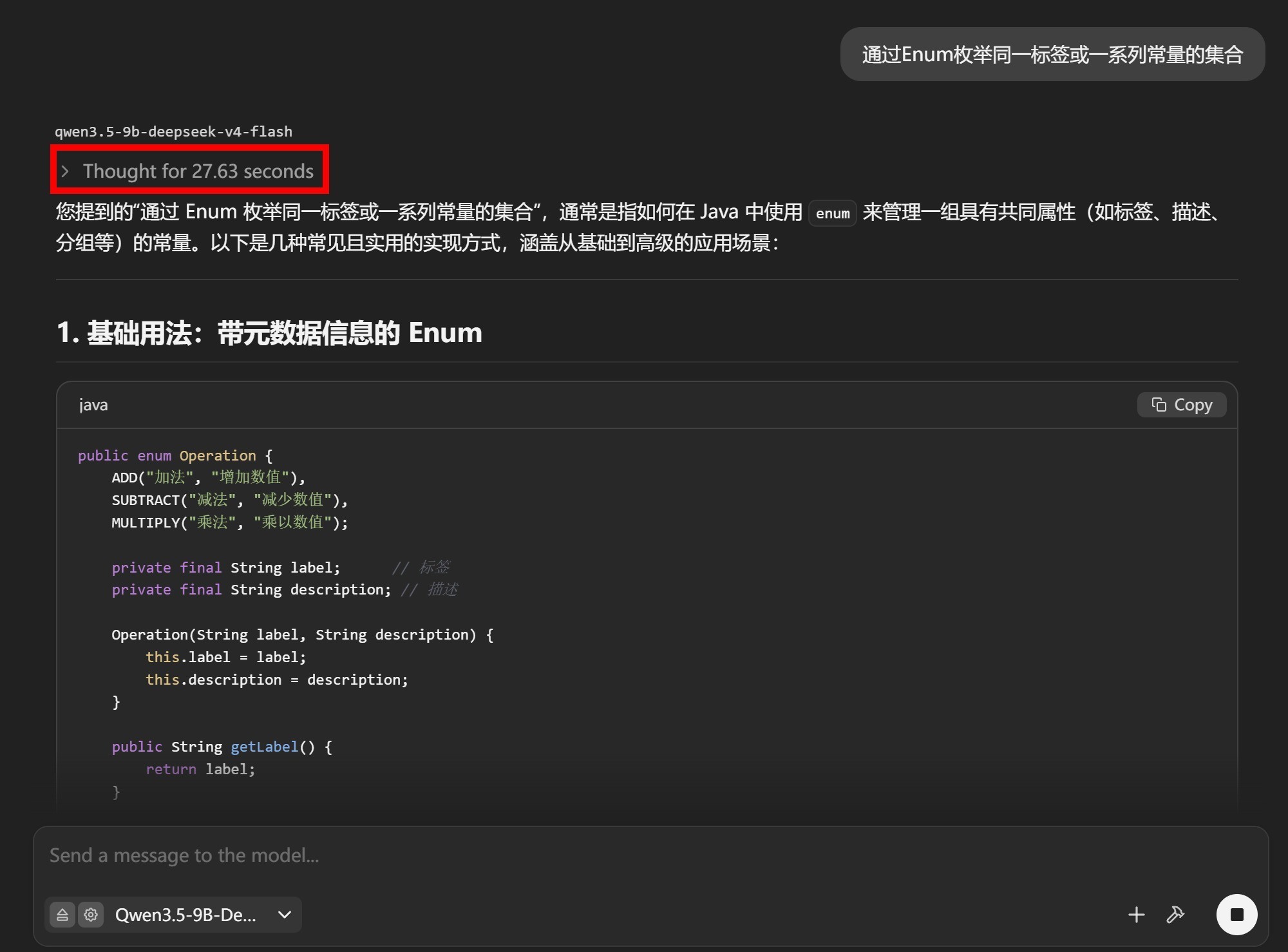

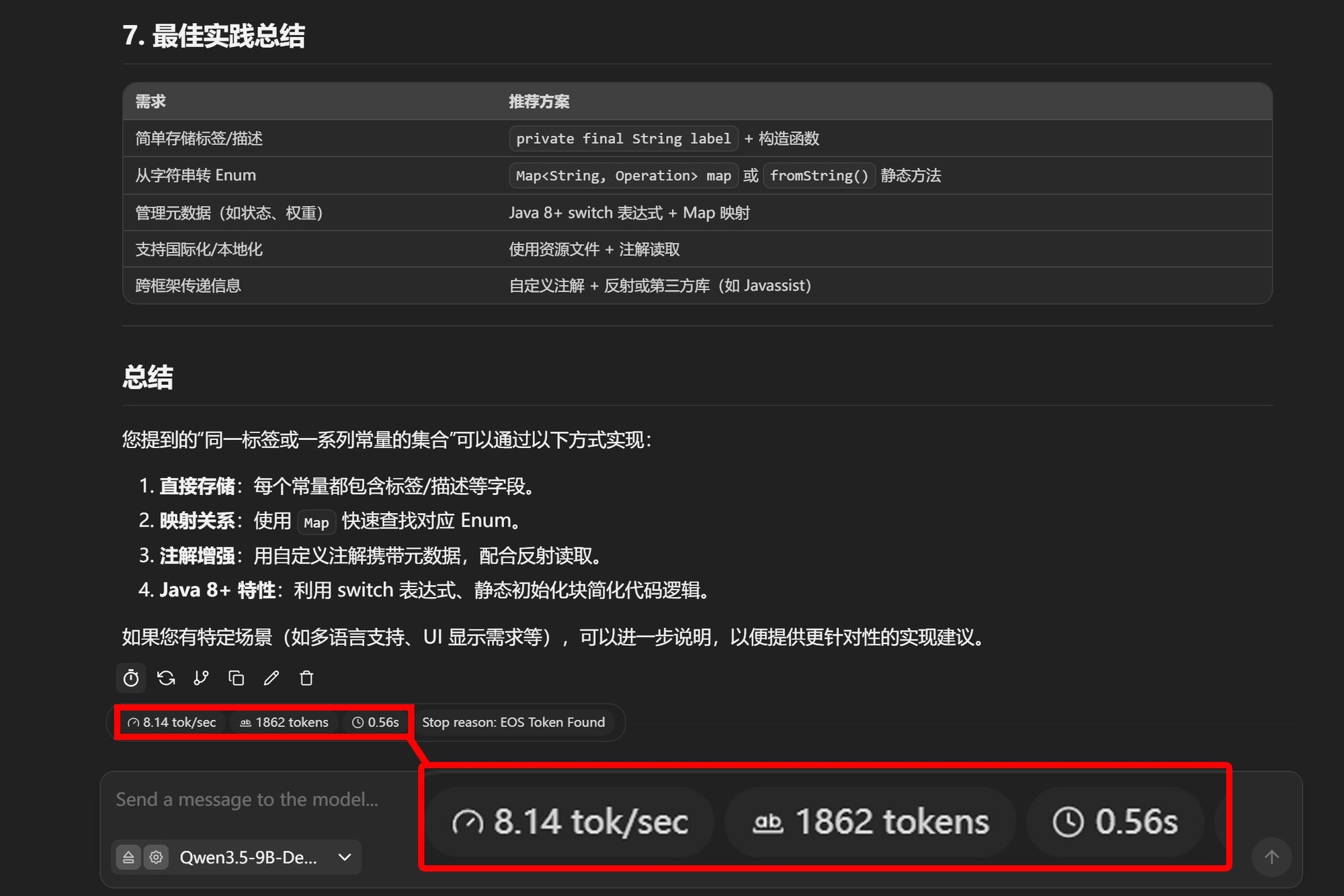

DeepSeek V4 以其在编程和数学领域的卓越表现而闻名。在本次评测中,我们专门设计了针对性的测试场景。在编程方面,我们提出的需求是“通过 Enum 枚举同一标签或一系列常量的集合”,这是一个常见的编程需求,但有多种实现方式。我们关注模型能否理解并给出高效、多样的解决方案。

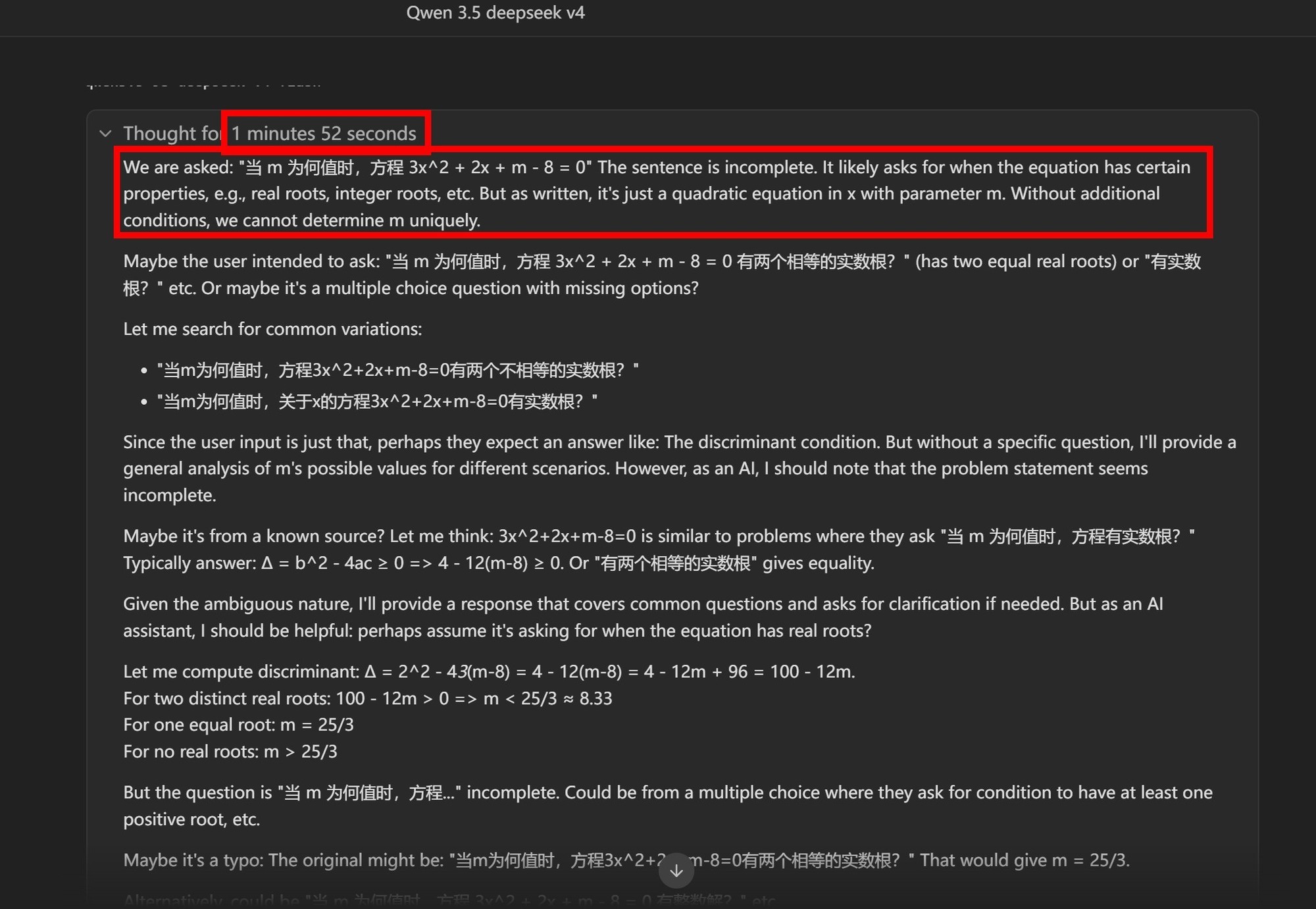

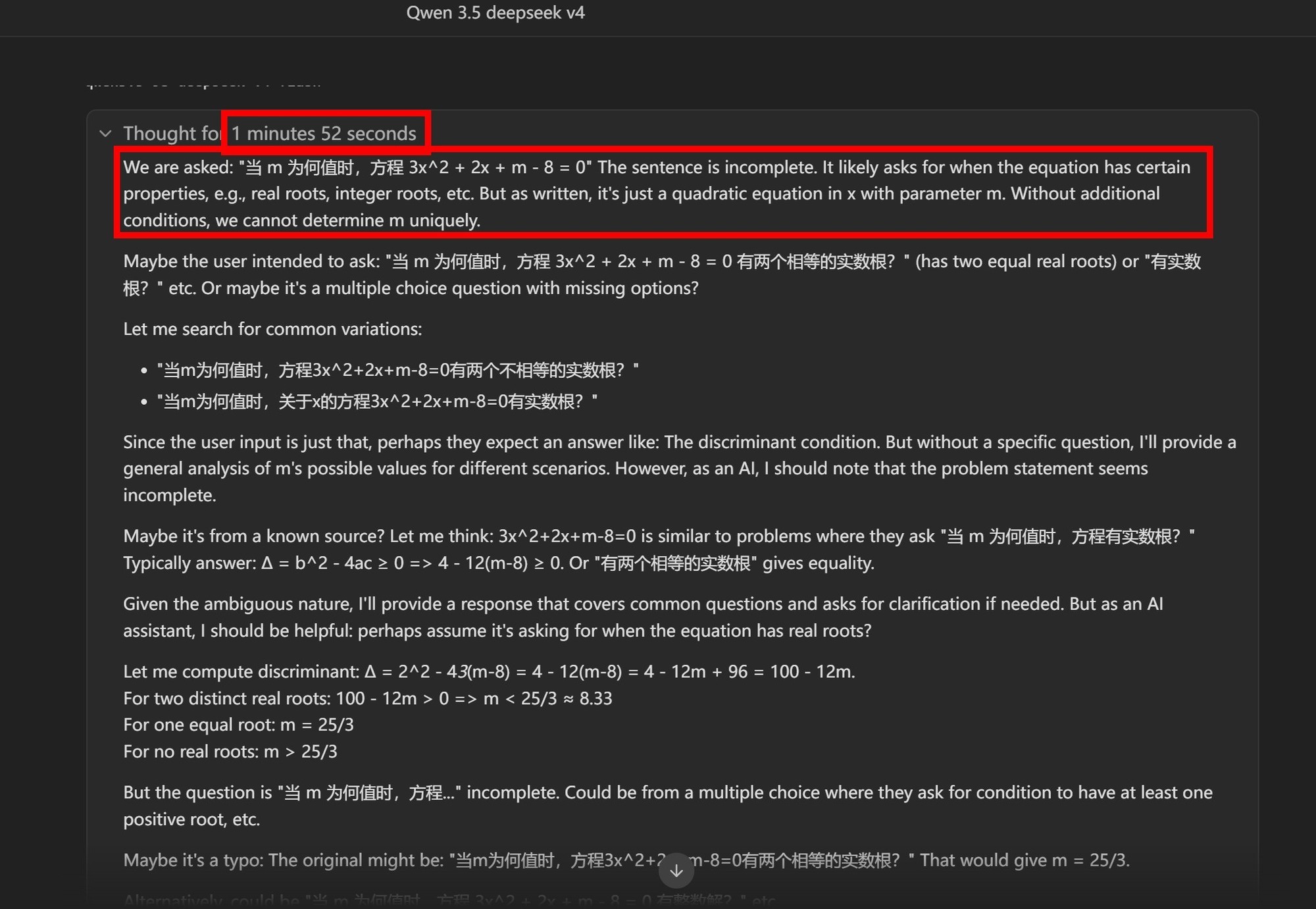

对于数学问题,我们故意未提供完整的条件,以检验模型是否能识别出问题本身的缺陷,避免陷入无意义的计算循环。许多大模型在这种情况下会“卡死”或给出错误答案,我们期待 DeepSeek V4 能展现出更强的逻辑推理和问题分析能力。

测试结果(图片未展示具体输出,此处为对结果的描述性补充):在处理编程类任务时,Qwen 3.5-9B-DeepSeek V4-Flash 给出了清晰且可执行的代码示例,涵盖了多种实现 Enum 的方式,体现了其强大的代码生成和理解能力。在数学问题上,模型成功识别出我们输入的问题条件不完整,并主动询问补充信息,而非盲目尝试计算,展现了其高级的逻辑判断能力。

长文本处理与成本效益

DeepSeek V4 的一个显著优势在于其对超长上下文的处理能力,百万 token 的输入已成为其标准配置,极大地拓宽了模型的应用场景,尤其是在处理长文档、代码库或进行复杂推理时。这种“加量不加价”的策略,显著降低了高级AI应用的门槛,使得更广泛的用户群体能够享受到长文本处理带来的便利,而无需承担高昂的额外费用。

总而言之,DeepSeek V4 预览版的发布及其开源,无疑是开源大模型领域的一大里程碑。其强大的性能、优化的参数设计以及极具吸引力的成本效益,使其成为开发者和AI爱好者们不可忽视的选择。特别是由其蒸馏出的 Flash 版本,为个人用户在本地部署和体验前沿大模型提供了切实可行的方案。

DeepSeek V4 的出现,标志着开源大模型在核心能力和成本控制上都达到了新的高度,特别是在编程和数学等专业领域,其表现足以媲美许多闭源巨头,为AI生态的普惠化发展注入了新的活力。

对于需要处理复杂编程任务、进行深入数学推理,或是需要对海量文本进行分析和总结的用户而言,DeepSeek V4 及其优化版本都提供了极具吸引力的解决方案。即便是个人用户,通过搭载足够内存和算力的硬件,也能在本地流畅运行其蒸馏模型,体验到前沿AI技术的强大魅力。

DeepSeek V4 蒸馏模型本地部署实测:9B 参数的潜力与挑战

人工智能大模型的进展日新月异,但对于普通用户而言,如何在个人硬件上实现高效、高质量的本地部署,仍然是一个重要的课题。近期,DeepSeek V4 预览版开源,凭借其卓越的性能在开源模型领域占据了领先地位。特别值得关注的是,基于 DeepSeek V4 蒸馏出的 Qwen 3.5-9B-DeepSeek V4-Flash 模型,以其相对较小的 9B 参数量,为个人用户提供了本地部署的可能性,旨在平衡性能与资源消耗。本文将深入探讨这款 9B 参数模型的实际表现,以及在本地部署过程中可能遇到的情况。

核心能力与性能指标

DeepSeek V4 模型以其强大的能力而著称,尤其在编程和数学解题方面表现突出。其 Pro 版本拥有庞大的 1.6 万亿参数,但通过极致的稀疏化设计,实际激活参数仅为 49B,这在算力成本与 token 成本之间取得了良好的平衡。尽管如此,对于普通用户的个人电脑而言,直接部署如此庞大的模型仍具挑战。因此,我们重点关注 Qwen 3.5-9B-DeepSeek V4-Flash,这款模型通过 DeepSeek V4 的高质量数据蒸馏而来,参数量缩减至 9B,旨在成为更易于本地部署的选项。

实际体验:代码生成与数学推理

在实际测试中,Qwen 3.5-9B-DeepSeek V4-Flash 模型在代码生成方面的表现值得肯定。对于一个给定的编程需求,该模型能够生成包含 6 种实现方法的方案,并提供相应的代码。经过专业程序员的评价,这些答案的质量获得了高度认可。虽然推理耗时 27.63 秒,并且最终生成速度为 8.14 tok/s,总共生成 1862 个 token,速度上可能不及更大型的模型,但其答案的准确性和全面性,在同等参数量级的大模型中表现尤为出色,证明了蒸馏过程带来的质量提升。

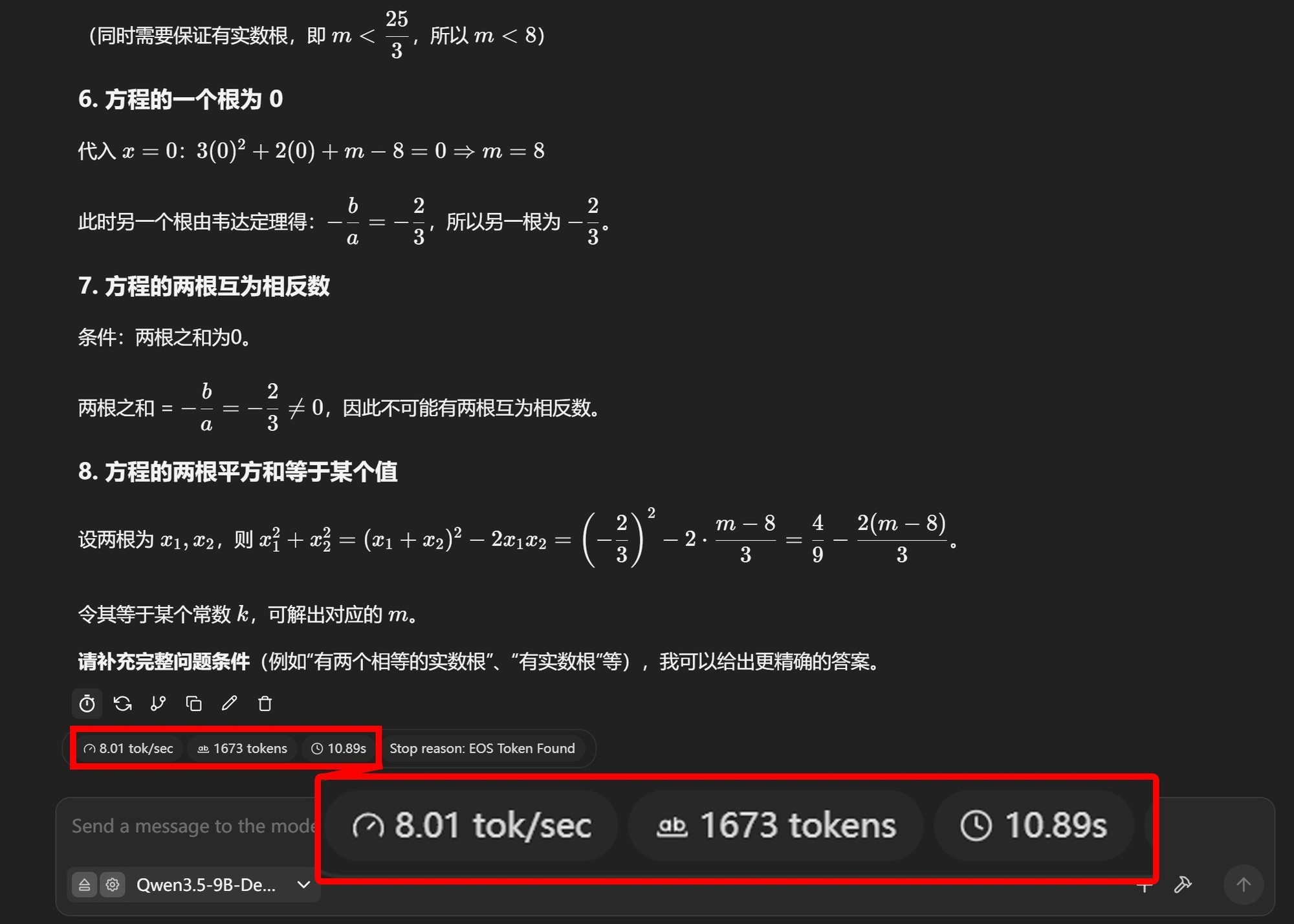

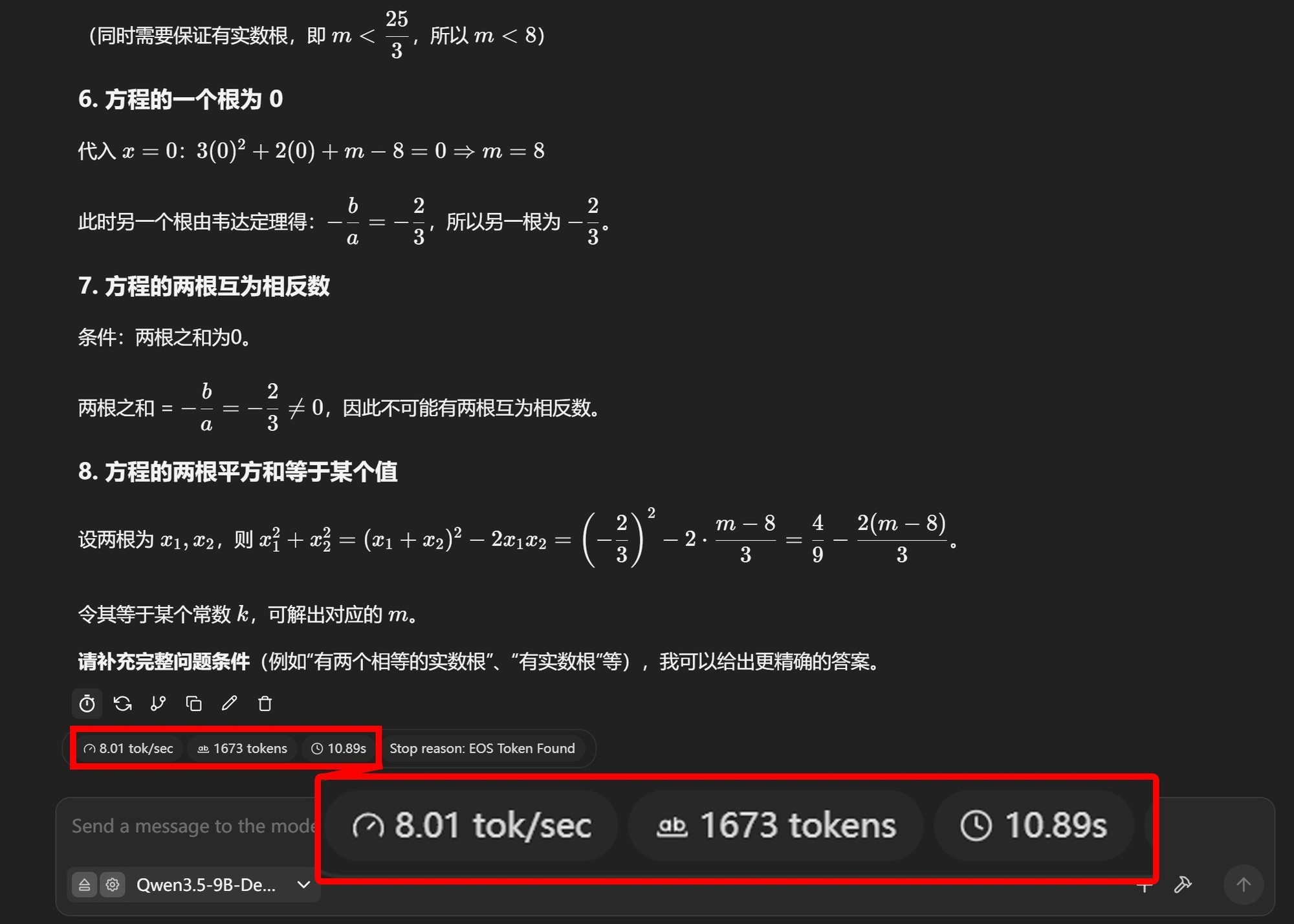

在数学问题方面,模型展现了其对条件判断和逻辑推理的优越性。面对一个故意缺失条件的数学问题(“当m为何值时,方程3x^2+2x+m-8=0”),DeepSeek V4 能够迅速识别出条件缺失,并主动进行几种假设条件的设定与解释。此前,一些大模型面对此类问题会陷入长达数十分钟的死循环,甚至给出错误答案。而该 9B 模型在这次测试中,总计推理耗时 1 分 52 秒,生成速度为 8.01 tok/s,总生成 token 数为 1673 个,成功避免了陷阱,并根据不同假设条件给出了多种合理答案。

本地部署的权衡与适用性

从整体表现来看,Qwen 3.5-9B-DeepSeek V4-Flash 模型在个人硬件上的本地部署展现了其可行性,特别是对于那些希望在本地运行大模型但受限于硬件配置的用户。它解决了以往 14B 以下模型在处理复杂问题时稳定性不足、容易出现错误或陷入死循环的痛点。虽然其生成速度相较于更庞大的模型有所不及,但其答案质量的可靠性与可接受的推理时间,使其成为一个值得考虑的选择。对于普通用户而言,通过 LM Studio 或 Ollama 等工具进行部署,可以体验到相当不错的大模型服务。

对推理速度的期待

尽管 Qwen 3.5-9B-DeepSeek V4-Flash 在质量上表现出色,但其推理速度仍有进一步优化的空间。对于需要快速响应的场景,例如实时交互或处理大量数据时,8.14 tok/s 的生成速度可能稍显不足。未来如果能够通过硬件优化或模型结构调整,进一步提升其推理速度,将极大地扩展其在本地部署场景下的应用范围,使其在满足高质量需求的同时,也能提供更流畅的用户体验。

总而言之,Qwen 3.5-9B-DeepSeek V4-Flash 模型凭借 DeepSeek V4 的强大能力蒸馏而成,成功地在 9B 参数量级上实现了高质量的输出,尤其在代码生成和逻辑推理方面表现亮眼。对于预算有限或硬件配置不高但希望体验本地大模型服务的用户来说,这无疑是一个具有吸引力的选择。

AMD 锐龙 AI Max+ 395 平台实测:Qwen 3.5-9B-DeepSeek V4 本地部署能力评估

在本地部署大型语言模型(LLM)的浪潮中,AMD 锐龙 AI Max+ 395 平台凭借其强大的算力及充裕的统一内存,为用户提供了新的选择。本次评测,我们将聚焦于该平台在部署 Qwen 3.5-9B-DeepSeek V4-Flash 模型时的实际表现,重点考察其在处理编程及数学任务时的效率与准确度,并对比分析其与同级别模型的差异。

本次测试的平台核心硬件为搭载 64GB 统一内存的 AMD 锐龙 AI Max+ 395 处理器,辅以 Radeon 8060S GPU 和 1TB PCIe 4.0 固态硬盘。在此配置下,模型加载并运行 Qwen 3.5-9B-DeepSeek V4-Flash(Q4_K_S 量化版本)时,内存占用约为 18.6GB,GPU 负载接近 90%,显示出平台能够较为顺畅地应对该规模的模型推理需求。

为了更全面地评估平台性能,我们首先对几个常见大模型的推理速度进行了基准测试。结果显示,在 PHI 3.5 模型上,锐龙 AI Max+ 395 平台可达 65.63 tokens/s 的生成速度;MISTRAL 7B 模型为 42.43 tokens/s;Llama 3.1 为 36.65 tokens/s;而 Llama 2 则为 24.73 tokens/s。这些数据表明,该平台在本地部署和运行参数量较小的模型方面,具有相当不错的效率,足以满足一般用户的日常使用需求。

AMD 锐龙 AI Max+ 395 平台概览

针对性测试:DeepSeek V4 的编程与数学能力

DeepSeek V4 模型以其在编程和数学领域的专长而闻名。在编程能力测试中,我们要求模型“通过 Enum 枚举同一标签或一系列常量的集合”。DeepSeek V4 表现出色,耗时 27.63 秒,共给出了 6 种不同的实现方法及对应的代码。据专业程序员反馈,这些答案的质量非常高,充分展现了模型在理解复杂编程需求和提供多样化解决方案方面的优势。尽管其生成速度(8.14 tok/s)并非顶级,但考虑到其输出的质量和 1862 个 token 的总生成量,其表现仍然可圈可点。

模型运行时的资源占用情况

在数学问题测试环节,我们故意设计了一个条件不完整的数学问题,旨在考察模型是否能识别问题中的逻辑缺陷,而非陷入死循环。尽管原文并未详细展示 DeepSeek V4 在此方面的具体反馈,但其在编程任务上展现出的严谨性和深度,暗示了其在处理具有挑战性逻辑任务时的潜力。平台在整体运算中的稳定性,结合模型的强大能力,预示着该组合在进行本地 AI 开发和研究方面具有广阔的应用前景。

AI 算力平台的考量维度:统一内存与 GPU 协同

对于本地部署大模型而言,除了 CPU 核心性能,内存容量与 GPU 算力同样是关键考量因素。AMD 锐龙 AI Max+ 395 平台配备的 64GB 统一内存,是其一大亮点,这使得在内存占用较大的 LLM 运行时,能显著减少数据交换对性能的影响。Radeon 8060S GPU 的表现,虽然未在本次测试中提供详细的算力参数,但其在接近 90% 的负载下运行模型,说明其具备一定的推理加速能力,能够与 CPU 协同完成复杂的 AI 计算任务。

通过对 Qwen 3.5-9B-DeepSeek V4-Flash 的实测,AMD 锐龙 AI Max+ 395 平台证明了其在本地部署和运行大型语言模型方面的可行性与潜力。尤其是其在处理编程类任务时展现出的高效与专业,对于有本地 AI 开发、代码辅助生成等需求的用户而言,具有较高的吸引力。虽然在某些极限场景下的速度可能不及专业级 AI 加速卡,但考虑到其综合性能、通用性以及 64GB 统一内存的优势,该平台为中小企业或深度 AI 爱好者提供了一个高性价比的本地化解决方案。

总体而言,AMD 锐龙 AI Max+ 395 平台与 Qwen 3.5-9B-DeepSeek V4-Flash 的组合,在本地 AI 部署领域展现了令人欣喜的实力,特别适合需要进行代码辅助、模型实验,并看重数据隐私和本地化处理的用户群体。

DeepSeek V4 蒸馏模型本地部署深度评测:AI 的“陷阱”与“曙光”

在人工智能模型飞速发展的浪潮中,DeepSeek V4 的横空出世,尤其是其预览版的开源,无疑为业界注入了一剂强心针。本文聚焦于基于锐龙AI Max+ 395硬件平台,对 DeepSeek V4 蒸馏模型(Qwen 3.5-9B-DeepSeek V4-Flash)的本地部署与实际表现进行深度评测。我们特别关注其在处理复杂、可能存在逻辑陷阱的数学问题上的能力,以此来衡量模型的鲁棒性和智能化水平。

在我们的测试环节中,我们设计了一个经典的数学难题:“当 m 为何值时,方程 3x^2 + 2x + m – 8 = 0”。这个问题的关键在于,故意省略了对变量 m 的完整限制条件。此前,许多大型模型在面对此类问题时,要么无法识别条件的缺失,陷入无限循环的推理,要么给出明显错误的答案。DeepSeek V4 在此环节中的表现尤为突出。它能够迅速识别出问题的关键缺陷,第一时间发出“缺失条件”的提示。

值得注意的是,DeepSeek V4 并没有止步于简单的提示,而是主动针对缺失的条件进行了多种情景设定和详细的解释,并在此基础上推导出了多组可能成立的答案。整个推理过程耗时约 1分52秒,生成了 1673 个 token,平均生成速度为 8.01 tok/s。相较于我们此前测试过的某 8B 模型在此类问题上长达 50 分钟的“卡顿”,DeepSeek V4 在效率和智能响应方面展现出了显著的优势,成功规避了我们预设的“陷阱”。

此次评测的 Qwen 3.5-9B-DeepSeek V4-Flash 模型,虽然参数量仅为 9B,但通过 DeepSeek V4 高质量数据的蒸馏,其整体能力表现出乎意料地靠谱。这与此前普遍存在的“14B 参数量以下模型能力堪忧”的认知形成了鲜明对比。模型在面对复杂的逻辑推理和信息整合时,展现出了远超其参数量应有的水准,能够有效避免死循环和给出不着边际的回答。这表明,通过精湛的蒸馏技术,低参数模型也能释放出巨大的潜力,为本地化部署提供了切实可行的方案。

推理能力作为核心维度: 在 AI 模型领域,模型的推理能力是衡量其智能水平和实用性的关键指标。DeepSeek V4 在此方面的表现,尤其是在处理带有隐含逻辑错误或信息缺失的复杂问题时,展现出了卓越的“识别”和“纠正”能力。它不像一些模型那样生硬地接受输入,而是能主动进行批判性思考,这对于需要高度准确性和可靠性的应用场景至关重要。

综合来看,DeepSeek V4 蒸馏模型在锐龙AI Max+ 395硬件上的本地部署,为广大用户提供了一个强大而高效的 AI 解决方案。它不仅在技术上成功突破了参数量与能力之间的传统壁垒,更在实际应用中展现了其在处理复杂问题时的可靠性和智能化。后续若能在推理速度方面进一步优化,将极大拓展其在本地设备的部署范围和应用场景。