MiniMax大模型出现人名识别错误 稀宇科技回应训练缺陷

稀宇科技 M2 系列模型解析:特定人名无法识别背后的词元“挤压”困境

近日,稀宇科技(MiniMax)发布了一份深度技术报告,系统性地剖析了其 M2 系列大模型在处理如“马嘉祺”等特定人名时出现识别障碍的根本原因。这一技术难题的背后,揭示了当前大规模语言模型在训练过程中普遍存在的、由数据分布不均引发的词元向量空间“挤压”现象。

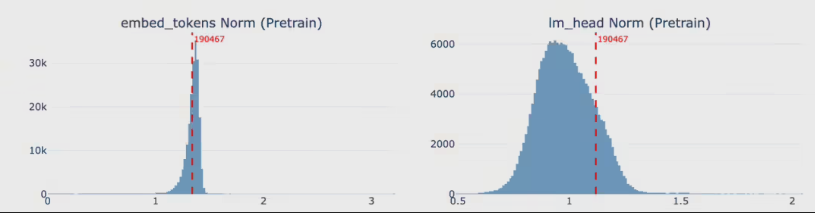

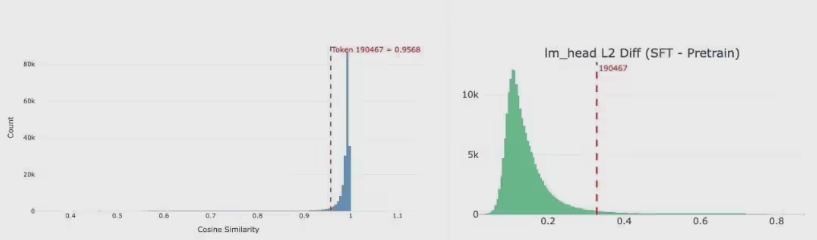

问题的关键点在于模型处理文本的基本单位——分词器(Tokenizer)的运作机制。以“马嘉祺”为例,该名字在模型内部被分解为“马”和“嘉祺”两个独立的词元。虽然模型在海量通用数据的预训练阶段已接触过这两个词汇,但在随后的指令微调(后训练)阶段,由于训练数据中“嘉祺”一词的出现频率极为稀少,导致该词元几乎处于“零训练”状态。与之形成鲜明对比的是,代码符号、工具调用等高频词元在训练过程中被持续强化,其向量参数的更新不断“挤压”着低频词元的生存空间。最终,这些低频词元因偏离了正确的概率区间,导致模型在尝试生成特定艺人姓名时,被迫选择发音相近的替代词,如“佳琪”或“琪琪”。

稀宇科技的深入排查发现,这种“词元退化”现象并非孤立事件,而是具有普遍性。通过对模型词表中近20万个词元的全面扫描,研究人员发现约4.9% 的词元表现出显著的性能衰退。其中,日文词元的退化比例尤为突出,高达29.7%。这直接解释了该模型在进行日语对话时,偶尔会出现莫名混入俄语或韩语字符的现象,这正是低频外语词元受挤压后生成的连锁反应。

除人名和外语词汇外,受此影响的词元还包括 LaTeX 公式标记、维基百科的源码符号,甚至是某些 SEO 优化中常用的垃圾关键词。这一广泛的受影响范围表明,数据稀疏性对模型生成的全局性影响不容忽视。当后训练阶段所使用的精选数据集无法均衡地覆盖不同语言、特定领域术语或特殊符号时,模型的内部生成逻辑便会因此产生系统性偏差。

为了系统性地解决这一结构性难题,稀宇科技的研发团队设计并实施了一套精准的修复方案。该方案的核心在于通过构造覆盖全词表的合成数据,强制模型执行“复读”任务,从而为每一个词元都建立起一个生成频率的“底线保障”。这一策略有效地提升了模型在全词表输出时的稳定性。修复后的数据显示,模型在日语回答中混入异语字符的比例已从先前的47% 骤降至1%。目前,团队还在积极探索更深层次的优化途径,例如在微调阶段重新引入预训练语料,或者直接清理词表中不再使用的冗余标记,以期进一步巩固模型的可靠性。

此次 M2 系列模型在特定人名识别上的失误,为整个大模型行业敲响了警钟。模型分词器通常基于海量的通用网络语料构建,但下游的实际应用场景却呈现出高度的专业化和特异性。如何在追求语义多样性和泛化能力的同时,从基础的统计学层面确保所有重要词元的充分覆盖,将成为未来提升大模型鲁棒性和可靠性的关键技术挑战。