DeepSeek V4双版本发布,Pro与Flash定价公开

AI 领域再添重磅实力派,DeepSeek 今日正式揭晓其最新一代旗舰大模型——DeepSeek V4。此次发布最大的亮点在于其精细化的产品策略,推出了 DeepSeek-V4-Flash 与 DeepSeek-V4-Pro 两款版本,分别针对不同的应用场景和性能需求,并公布了极具竞争力的定价策略。

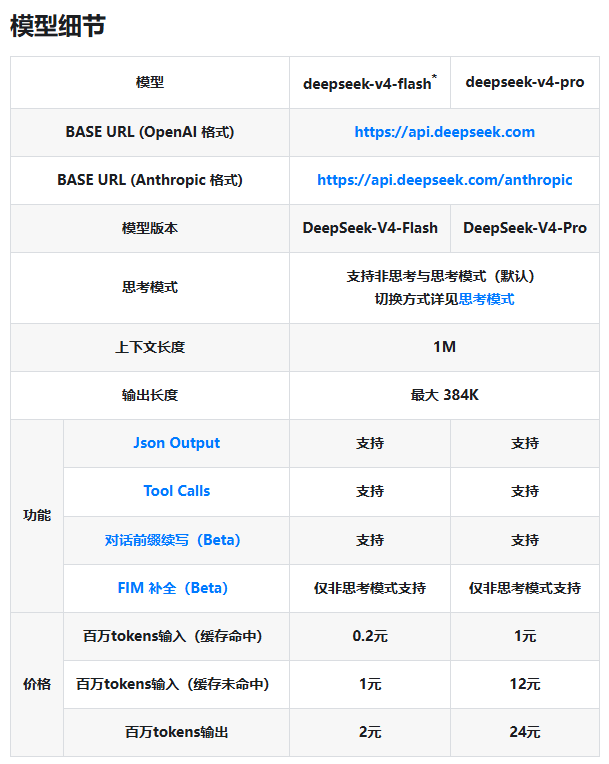

DeepSeek V4 的模型矩阵进行了优化整合,将原有的 deepseek-chat 和 deepseek-reasoner 模型升级并划分为两大核心版本。DeepSeek-V4-Flash 版本将主打高效能与极高性价比,尤其适合需要快速响应的通用对话以及基础文本处理任务。而 DeepSeek-V4-Pro 版本则专注于深度思考、复杂逻辑推理以及对高性能算力有较高要求的场景,能够提供更强的处理能力。

此次发布的另一大看点是 DeepSeek V4 的定价策略。新模型提供了清晰透明的阶梯化计费方案,并引入了缓存机制来显著降低企业用户的长期使用成本。具体而言,DeepSeek-V4-Flash 的计费标准为:输入(缓存命中)0.2 元/百万 Tokens,输入(缓存未命中)1 元/百万 Tokens,输出 2 元/百万 Tokens。DeepSeek-V4-Pro 的定价则为:输入(缓存命中)1 元/百万 Tokens,输入(缓存未命中)12 元/百万 Tokens,输出 24 元/百万 Tokens。该定价逻辑鼓励开发者通过缓存优化来降低算力消耗,实现成本的精细化控制。

Flash 版本以 1 元/百万 Tokens(缓存未命中)的价格,极大地降低了开发者接入先进 MoE 模型架构的门槛。Pro 版本在复杂推理任务上的定价,则为企业构建知识库问答、自动化代理(Agent)等高阶应用提供了兼顾性能与成本的优质国产解决方案。官方同时提示,原有的 deepseek-chat 和 deepseek-reasoner 模型名称将逐步弃用,开发者可即日起调用 deepseek-v4-flash 和 deepseek-v4-pro 模型以保证业务的平稳过渡。

本次 DeepSeek V4 的发布,标志着国产大模型在性能、场景细分和商业化定价方面迈出了重要一步,为行业带来了新的参考标准。