阿里通义千问发布文生图新模型Qwen-Image

阿里通义千问团队近期发布了其首个开源的文生图基础模型 Qwen-Image,该模型拥有 20 亿参数,采用了多模态扩散变换器(MMDiT)架构。此次开源标志着通义千问系列在多模态生成领域迈出了重要一步,旨在推动图像生成与编辑技术的创新和普及。

Qwen-Image 在处理文本渲染方面表现出显著的突破性能力,能够精准生成多行布局、段落级甚至细粒度的文字内容,无论是英语还是中文,都能达到高保真度的输出效果。例如,在模拟宫崎骏风格的动漫场景时,该模型可以清晰渲染店铺招牌上的文字、人物动作表情,甚至连酒缸上的细微字体都能准确呈现。在中文对联的生成任务中,Qwen-Image 不仅能正确区分横批、左右联,还能巧妙地融入书法艺术效果,展现了其对文化元素的理解和表达能力。

在英文文本渲染方面,Qwen-Image 同样展现了其强大的能力,能够准确地在图像中嵌入如书店橱窗展示信息或复杂信息图表中的文字内容,并使其与整体画面风格和谐统一。模型在处理少量或大量文字时,依然能保持高度的准确性和清晰度,例如在纸张或玻璃表面生成长段落文字或手写体内容,都极为逼真。

除了文本生成,Qwen-Image 在图像编辑领域也提供了强大的支持。通过增强的多任务训练,模型在进行风格迁移、物体添加与删除、细节优化以及人物姿态调整等操作时,能有效保持图像的一致性。这一能力使得非专业用户也能轻松进行高质量的图像编辑,极大地降低了视觉内容创作的技术门槛,为创意产业带来了新的可能性。

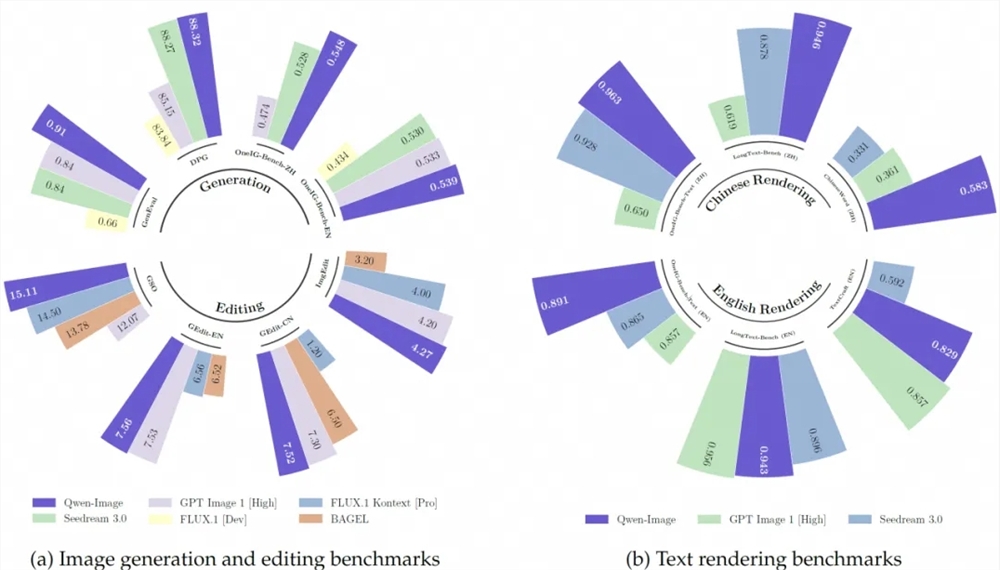

Qwen-Image 在多个公开的基准测试中均取得了领先的性能,包括通用图像生成的 GenEval、DPG 和 OneIG-Bench,以及图像编辑的 GEdit、ImgEdit 和 GSO 等。尤其是在中文文本渲染的评测中,Qwen-Image 的表现远超现有最先进的模型,巩固了其在先进图像生成领域的地位。

该模型已在魔搭社区、Hugging Face 和 GitHub 等主流平台开放源码,并提供了详细的技术报告和演示。用户可以通过 QwenChat 平台的“图像生成”功能进行体验。

Qwen-Image 的开源为图像生成和编辑领域注入了新的活力,其在文本渲染和多模态理解上的突破,预示着AI在内容创作领域将有更广泛的应用前景。