阿里巴巴南开共研视频压缩新突破

阿里巴巴通义实验室与南开大学的合作成果——LLaVA-Scissor——近期面世,这项新技术致力于攻克视频大模型在处理海量帧数据时面临的效率瓶颈,为视频理解与推理带来了革新性的解决方案。

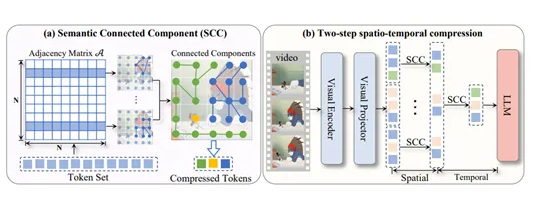

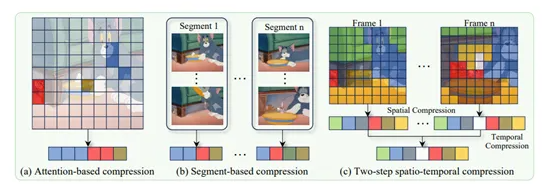

LLaVA-Scissor 提出的核心在于其创新的基于图论的 SCC (Strongly Connected Components) 压缩算法。该算法通过深入分析视频 token 间的相似性,构建起一张复杂的相似性图谱,并从中精确识别出语义高度相关的 token 集合。通过用每个集合中的代表性 token 来取代整个集合,LLaVA-Scissor 能够大幅削减 token 总量,从而显著提升模型的推理速度和处理能力。

为了进一步优化压缩效果,LLaVA-Scissor 采用了精妙的两步时空压缩策略。首先,在空间维度上,技术能够精准识别单帧图像内部的语义关联区域,进行初步的 token 整合。随后,在时间维度上,它能有效地剔除不同帧之间重复或冗余的信息,确保最终压缩后的 token 序列能够以最紧凑的形态,同时包含丰富的时序和空间信息,全面覆盖视频内容。

实际测试结果充分印证了 LLaVA-Scissor 的强大实力。在多项关键视频理解基准测试中,该技术在低 token 保留率下的表现尤为抢眼。例如,在视频问答任务中,即使 token 保留率仅为 50%,LLaVA-Scissor 仍能与原始模型保持相当的性能水平。而在更具挑战性的 35% 和 10% token 保留率场景下,其性能优势更是超越了其他现有压缩方法。在处理长视频时,LLaVA-Scissor 同样展现出优异的能力,在 EgoSchema 数据集上,以 35% 的 token 保留率实现了 57.94% 的准确率。

LLaVA-Scissor 的诞生标志着视频大模型压缩技术迈上了一个新台阶,它不仅解决了现实应用中的效率难题,更为未来视频内容的高效处理和深度理解铺平了道路,有望在人工智能领域掀起新的浪潮。

LLaVA-Scissor 的技术突破,预示着视频大模型将在效率与性能之间找到更佳的平衡点,从而加速其在更多实际场景中的落地应用。