DeepSeek V4 Flash:小型推理引擎的革新

DeepSeek V4Flash:Metal 平台本地推理引擎的革新者

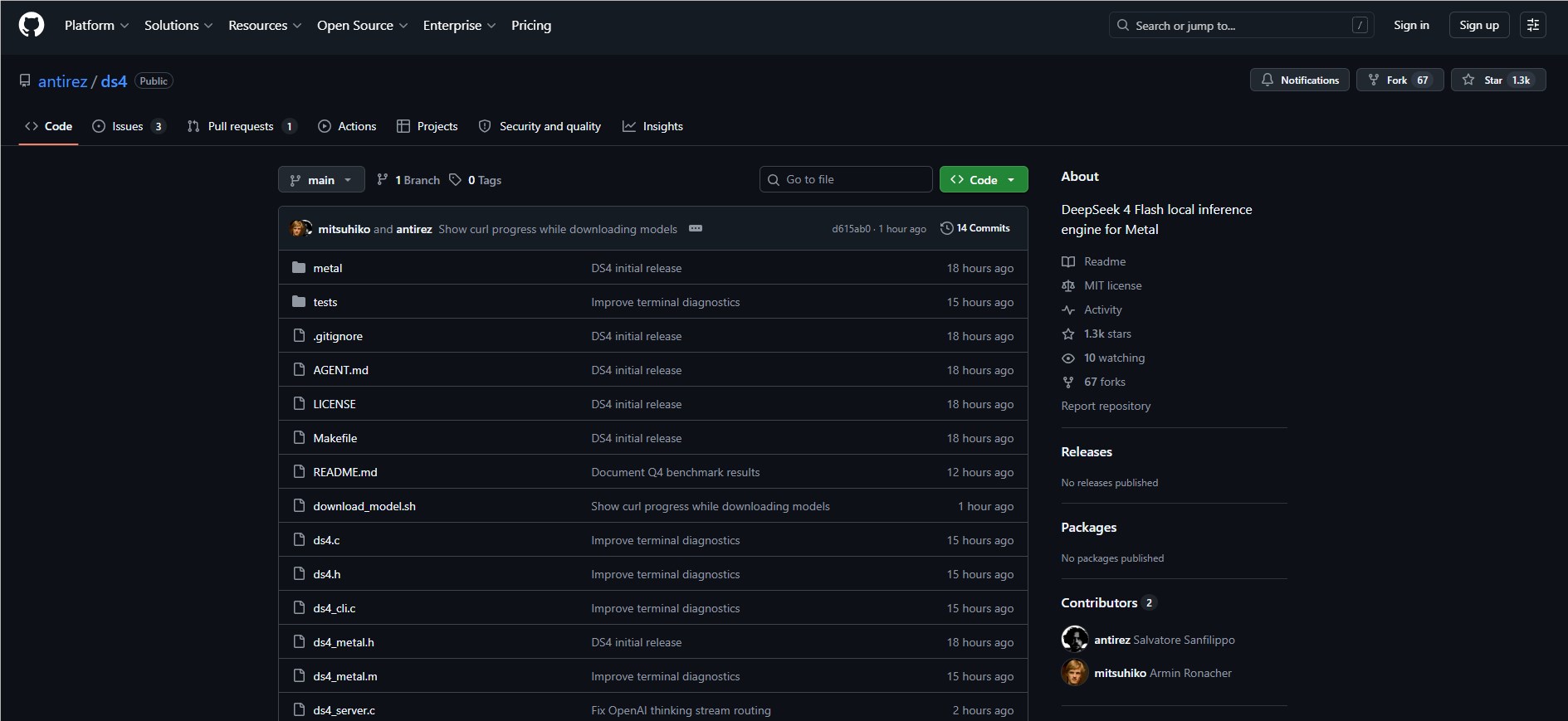

人工智能领域正迎来一款名为 DeepSeek V4Flash 的新型本地推理引擎,它专为 Apple 的 Metal 平台量身打造,旨在提供一种前所未有的高效和灵活的本地 AI 推理体验。与追求广泛兼容性的通用引擎不同,DeepSeek V4Flash 专注于优化 DeepSeek V4Flash 模型本身的执行,从而最大化其性能表现,为开发者和用户带来更流畅的 AI 应用体验。

DeepSeek V4Flash 的核心竞争力在于其独特的“思考模式”设计。通过采用更少的模型参数,该引擎实现了极速的推理过程。在处理复杂问题时,其“思考时间”最短可缩短至其他模型的三分之一甚至五分之一,显著提升了 AI 在需要快速响应和深度思考场景下的表现。这一特性使其在需要实时处理和高效率计算的应用中具有巨大潜力。

此外,DeepSeek V4Flash 拥有一项令人瞩目的技术突破:其上下文窗口能够支持高达一百万个令牌的推理。这一超大规模的数据处理能力,意味着该引擎在处理涉及海量信息的边缘问题时,能够展现出强大的信息整合和推理能力。无论面对的是复杂的知识渊博的意大利节目,还是涉及广泛的政治议题,DeepSeek V4Flash 都能凭借其深厚的知识储备提供精准的洞察。

在硬件支持方面,DeepSeek V4Flash 展现了出色的兼容性。在配备 128GB RAM 的 MacBook 上,该引擎能够实现 2 位量化运行,并能获得优异的性能。这为 Apple 生态用户带来了在本地设备上运行高性能 AI 模型的可能性。DeepSeek 团队也透露,未来将推出更强大的版本,持续提升用户体验和模型性能。

DeepSeek V4Flash 不仅仅是一个推理引擎,它还提供了一个完整的本地推理解决方案。这包括易于集成的 HTTP API 和为 DeepSeek V4Flash 模型专门设计的 GGUF 模型格式,确保了用户能够享受到无缝的开发和应用体验。不过,值得注意的是,当前版本仍处于 Alpha 阶段,其稳定性和功能性还有待进一步的优化和完善,这预示着其未来的发展空间巨大。

DeepSeek V4Flash 以其对 Metal 平台的深度优化、极快的思考速度和强大的上下文处理能力,为本地 AI 推理树立了新的标杆。对于追求极致性能和高效本地化 AI 体验的用户而言,这款引擎无疑是值得密切关注的黑马。