DeepSeek-V4预览版上线,万亿级上下文普惠大众

深度求索(DeepSeek)于2026年4月24日正式发布其全新系列模型DeepSeek-V4的预览版本,并同步启动开源。该系列模型的核心亮点在于其结构创新,首次实现了100万字(1M)超长上下文能力的标准化,在Agent协作、世界知识掌握及逻辑推理等关键领域,性能表现已达到国内及开源模型中的领先水平。

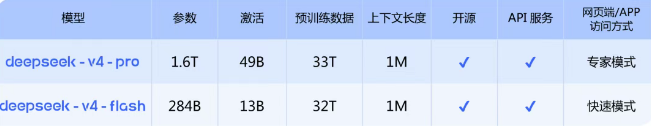

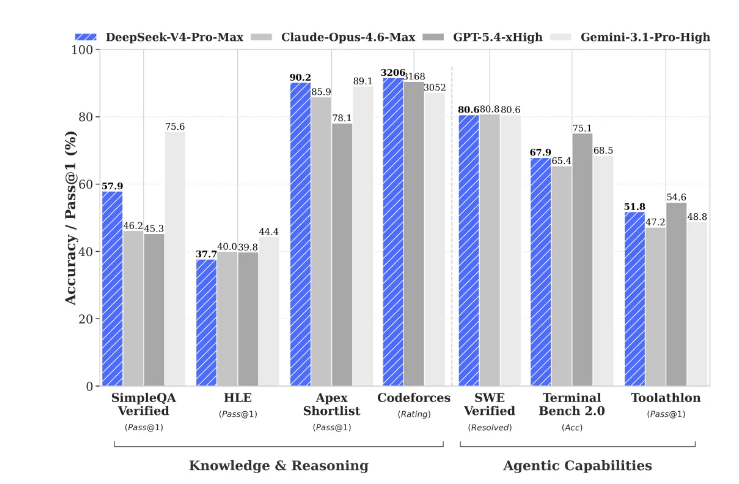

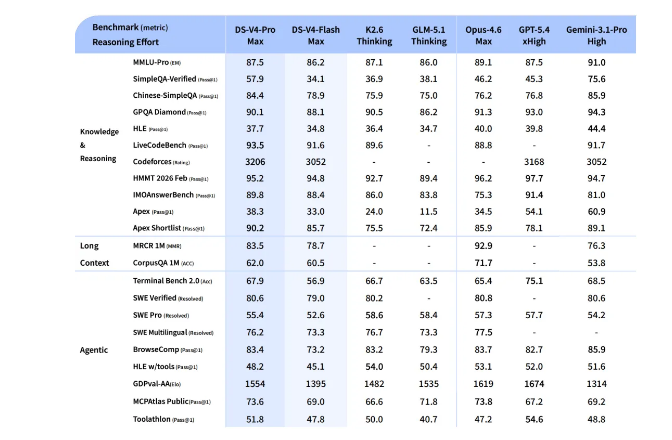

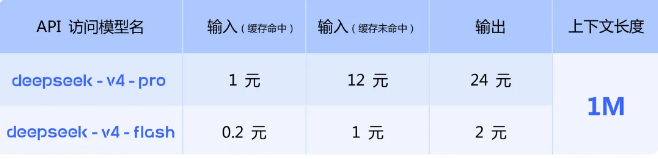

DeepSeek-V4系列推出了面向不同需求的双版本布局。其中,DeepSeek-V4-Pro拥有1.6T参数(激活49B),其性能目标是挑战顶级的闭源模型。在Agentic Coding评测中,该版本已实现开源模型中的最佳表现,交付质量接近Opus4.6。同时,在数学、STEM学科以及竞赛代码评测方面,它超越了所有公开评测过的开源模型,展示了卓越的世界级推理能力。另一版本DeepSeek-V4-Flash,拥有284B参数(激活13B),则聚焦于极致的性价比。尽管其世界知识储备略逊于Pro版,但在处理简单任务和Agent协作方面,Flash版与Pro版性能相当,能够提供更为快捷且经济的API服务。

实现超长上下文能力的普惠化,得益于DeepSeek-V4所采用的创新性DSA稀疏注意力机制。通过对Token维度进行有效压缩,该机制显著降低了处理百万字上下文所需的计算量和显存资源。这意味着1M的超长上下文将成为DeepSeek所有官方服务的标准配置,有效解决了当前行业内长文本处理成本高昂的瓶颈问题。

此外,DeepSeek-V4在Agent生态的深度适配方面也进行了重点优化。针对Claude Code、CodeBuddy等主流Agent产品,模型支持“非思考模式”与“思考模式”的切换,并在API层面开放了reasoning_effort参数。用户可根据具体任务的复杂度,灵活调节模型的思考强度(high/max),从而大幅提升模型在代码生成、文档处理等复杂应用场景下的表现效率。

用户即日起可通过DeepSeek官网或官方App体验DeepSeek-V4最新模型,API服务也已同步更新。值得注意的是,旧有的deepseek-chat和deepseek-reasoner模型名称将在三个月后,即2026年7月24日停止使用。DeepSeek-V4的开源模型已上线Hugging Face和魔搭社区,详细技术报告亦同步披露于Hugging Face仓库中。此次发布不仅证明了开源模型在追赶闭源模型长上下文及Agent能力方面的潜力,更以技术架构的突破,为人工智能通用性(AGI)的普及化进程奠定了重要基础。

DeepSeek-V4的发布标志着超长上下文AI模型正加速向普惠化迈进,尤其在开源领域,其带来的性能飞跃和成本效益优化,预示着AI应用将迎来更广泛的普及和更深入的集成。