腾讯混元3.0大模型免费开放,姚顺雨团队实现性能大涨40%

腾讯混元3.0大模型上线预览:关键性能显著提升,MoE架构引关注

在国内互联网巨头中,腾讯此前在AI大模型领域的动作相对谨慎。然而,在去年高薪引入AI大神姚顺雨之后,腾讯新一代大模型“混元3.0”(Hy3)的进展受到业界广泛关注。目前,混元3.0已以“Hy3 preview”的名义在OpenRouter平台免费上线,供用户体验。

混元3.0模型采用了MoE(混合专家)架构,具备三个推理级别,上下文长度达到262K,推理速度为23Token/s。值得注意的是,此次上线的预览版是文本型模型,而此前的混元2.0则以多模态能力著称。

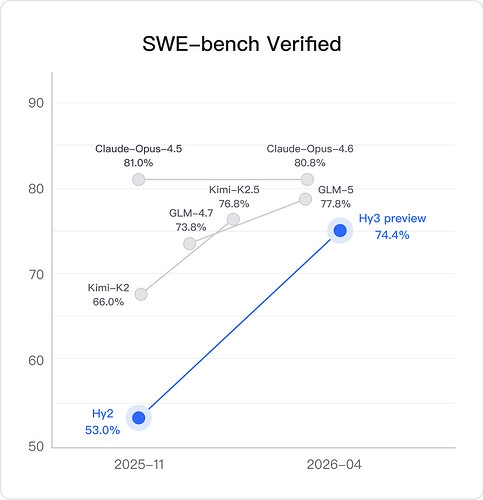

虽然混元3.0的具体性能数据尚未全面公布,但已有网友提供了其在SWE-Bench编程能力测试中的对比数据。

测试结果显示,混元3.0预览版在此项测试中得分高达74.4%,相较于混元2.0的53.0%,编程能力提升超过40%。这一表现已接近GLM-4.7的水平,尽管与GLM-5以及目前的标杆Opus 4.6仍存在一定差距。

结合此前的市场传闻,混元3.0在性能上的显著提升,与姚顺雨加入腾讯后有望带来OpenAI级别研发能力的预期相符。这一进展表明,腾讯在大模型研发上正在加速追赶,并已在关键能力点上取得突破,进入国内顶级模型行列。

据了解,混元3.0此前也曾在腾讯的AI软件“元宝”中出现,预计本周将正式发布。届时,其可能与近期备受关注的DeepSeek V4形成同期竞争,为行业带来更多技术交流与比较的契机。

混元3.0的上线预览及其在特定性能指标上的显著提升,对国内大模型竞争格局而言,意味着头部科技公司之间的技术差距正在逐步缩小。尤其在引入顶尖人才后,腾讯在模型迭代速度和表现上展现出积极态势,将进一步加剧市场竞争,促使各方加速技术创新。

对于用户和开发者而言,更多高性能、具备特定优势的模型选择将不断涌现。这不仅会推动大模型在实际应用场景中的落地效率,也可能在未来影响开源与闭源模型的发展路线,催生更多元化的商业模式和技术生态。