腾讯发布具身多模态大模型,提升机器人交互能力

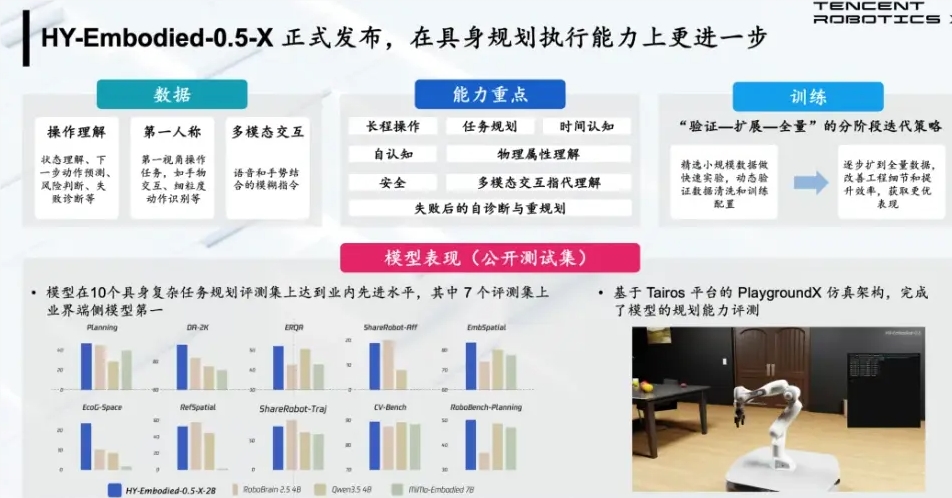

腾讯 Robotics X 实验室联合混元团队近期推出并开源了 HY-Embodied-0.5-X,这是一款针对具身任务进行深度优化的多模态大模型。该模型致力于提升机器人在复杂真实环境下的智能交互与执行能力,尤其在精细化操作、空间逻辑推理、动作预测以及风险评估等关键维度上,展现出卓越的性能。

HY-Embodied-0.5 系列共包含 HY-Embodied-0.5-MoT-2B 和 HY-Embodied-0.5-MoE-32B 两个版本。其中,MoT-2B 版本专为端侧部署设计,能够实现低延迟的实时响应,而 MoE-32B 版本则以其庞大的模型参数,胜任更为复杂的任务处理。HY-Embodied-0.5-X 的核心目标是推动机器人从单纯的“理解”迈向实际的“执行”能力,为家庭服务、桌面级操作等多样化的实际应用场景提供强大的技术支撑。

为了构建高质量的训练数据集,HY-Embodied-0.5-X 融合了团队自主采集的机器人第一视角操作数据与公开的具身数据集。这一整合使得模型不仅能深入理解操作指令和任务逻辑,还能显著增强其对含糊不清指令的解析能力。此外,团队通过引入思维链标注和建立数据质量闭环机制,有效保证了模型训练过程的效率与数据的精密度。

在模型训练策略上,HY-Embodied-0.5-X 采用了分阶段迭代的方法。首先,团队利用小规模但高质量的数据集来验证训练配置的有效性,随后逐步扩展至大规模数据训练,以此优化训练效率并确保模型的稳定性。这些先进的训练方法使得模型在空间理解、长程任务规划以及人机交互等方面取得了显著进步,让机器人能够更精准地感知环境并高效完成复杂指令。

HY-Embodied-0.5-X 作为一款多模态大模型,其输入形式涵盖文本指令和视觉信息,输出则表现为机器人动作序列的生成。它适用于需要机器人进行精准抓取、物体识别、路径规划以及复杂场景下安全交互的任务,但其上手门槛仍取决于机器人硬件平台的适配能力及下游应用的开发难度。这款模型的出现,有望在未来的机器人智能化进程中扮演重要角色。

HY-Embodied-0.5-X 的发布,标志着腾讯在具身智能领域取得了又一里程碑式的进展。该模型的开源及其在真实场景下的应用潜力,预示着人机协作新时代的到来,并可能深刻影响未来机器人技术的研发方向与实际落地。