CPU价格或迎上涨

近年来,人工智能(AI)的蓬勃发展很大程度上依赖于图形处理器(GPU)的强大算力,GPU 几乎成为 AI 训练和推理的代名词。然而,市场风向正悄然转变,曾经被视为 AI“配角”的中央处理器(CPU),其重要性日益凸显,甚至开始带动相关产品价格的上涨。

AI 算力新趋势:CPU 价值回升

近期,CPU 市场的动态引发了广泛关注。值得注意的是,此前在市场波动中表现相对低迷的英特尔公司,其股价出现了显著的增长。上周五,英特尔股价更是飙升了 27%,超越了其 26 年前创造的历史最高点。这一股价表现的背后,折射出 AI 领域对于算力需求正在发生深刻变化——仅仅依靠 GPU 已不足以满足所有需求,CPU 的性能同样成为影响 AI 整体效率的关键因素。

CPU 在 AI 发展历程中的角色演变

回顾 AI 的发展史,CPU 并非首次介入。在 GPU 成为主流之前,AI 的计算曾长期由 CPU 承担。例如,1998 年,图灵奖得主 Yann LeCun 在研究中提到,训练一个卷积神经网络(CNN)模型可能需要消耗单个 CPU 两到三天的时间。若要训练更复杂的模型,则需要数量更多、性能更强的 CPU 集群。然而,这种方式效率低下,且受限于当时的硬件成本,导致早期 AI 模型的效果普遍不佳。甚至一度出现,在学术界,带有“神经网络”字样的研究论文因其技术瓶颈而面临直接被拒稿的风险,研究者不得不采用其他术语来包装其成果。

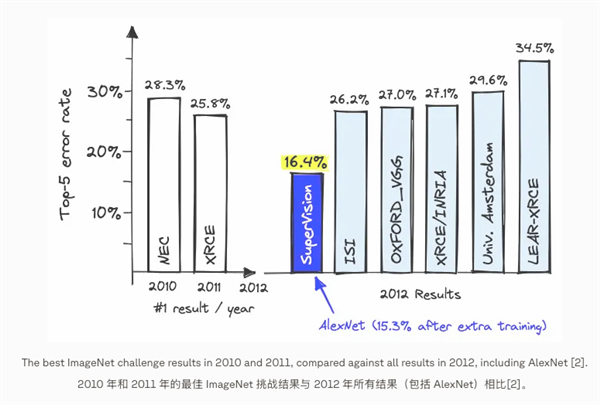

转折点出现在 2012 年的 ImageNet 竞赛,Geoffrey Hinton 及其团队利用两块市售的 GTX 580 显卡,将图像识别的准确率提升了十个百分点,取得了压倒性胜利。此次事件标志着 GPU 在 AI 领域的崛起,GPU 随之成为挖掘 AI 价值的关键“工具”,英伟达(NVIDIA)也因此成为市值巨头。在 GPU 占据主导地位的时代,CPU 逐渐退居幕后,主要承担辅助性任务。

Agent 技术的兴起驱动 CPU 新需求

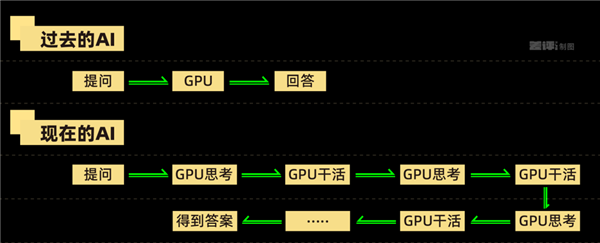

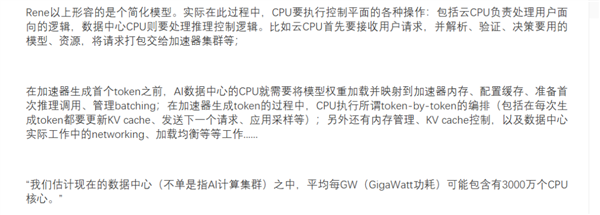

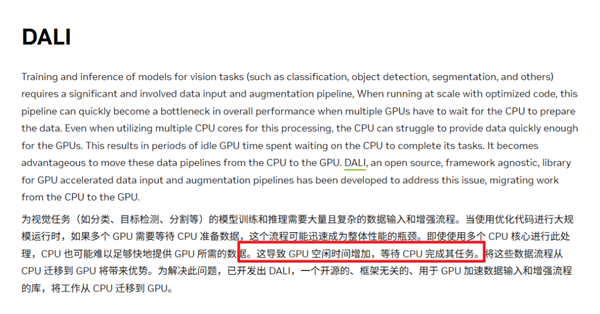

时至今日,随着 AI 应用场景的不断拓展,特别是 Agent(智能体)技术的兴起,CPU 的价值被重新发掘。传统的 AI 应用,如与 ChatGPT 或 DeepSeek 等模型进行交互,主要是一个相对简单的问答过程:用户提问,GPU 进行大规模矩阵运算以预测下一个 Token,然后生成答案。在这个过程中,CPU 的参与度较低。然而,Agent 类应用,如 Claude Code 或类比“龙虾”(此处为原文提及的代称),其工作模式发生了根本性变化。AI 需要具备自主规划、解决问题的能力。

以“购买奶龙玩偶”为例,AI Agent 的工作流程通常包括:首先识别“奶龙”是什么,如果未知,则需通过浏览器工具上网搜索相关信息;接着,它需要调用电商平台接口或其他工具,查询玩偶的价格、款式、店铺信誉和销量等数据;最后,AI 还需对收集到的信息进行整理、核实,判断哪些链接更可靠,哪些产品的性价比更高,并将最终结果呈现给用户。这个复杂的过程呈现出 GPU 和 CPU 之间交替协作的模式:GPU 负责处理核心的 AI 模型计算,而 CPU 则负责任务的规划、工具的调用、数据的预处理与后处理等逻辑和控制任务。

如果 CPU 性能不足,将直接影响 Agent 的整体响应速度和工作效率,导致 GPU 资源无法得到充分利用,出现“摆烂”现象。因此,为了确保 AI Agent 能够高效运行,避免 GPU 闲置,数据中心正着力增加 CPU 的配置,以满足日益增长的 AI 算力需求。例如,微软在其最新的数据中心建设中,就体现了这一趋势。

GPT-image-2做的图,示意一下

AI 算力新维度:CPU 的硬件考量

By semianalysis

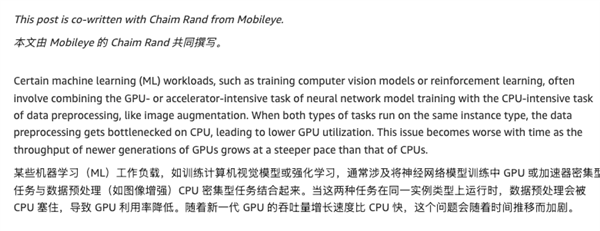

在当前 AI 算力需求的新格局下,CPU 的性能考量维度正在扩展。除了原有的计算速度和核心数量,AI 工作负载对 CPU 的功耗控制、散热能力以及其在整体硬件生态中的协同作用提出了更高要求。尤其是在大规模数据中心环境中,CPU 的能效比直接关系到运营成本。同时,CPU 作为系统的大脑,其供应链的稳定性也对 AI 硬件的整体供应构成重要影响。AI Agent 的复杂流程,意味着 CPU 需要与 GPU、内存、存储等硬件组件进行更紧密的配合,才能实现最佳性能。

CPU 在 AI 算力版图中价值重估,标志着 AI 基础设施正朝着更加均衡和高效的方向发展。未来,CPU 和 GPU 的协同优化将成为推动 AI 技术进步的关键。

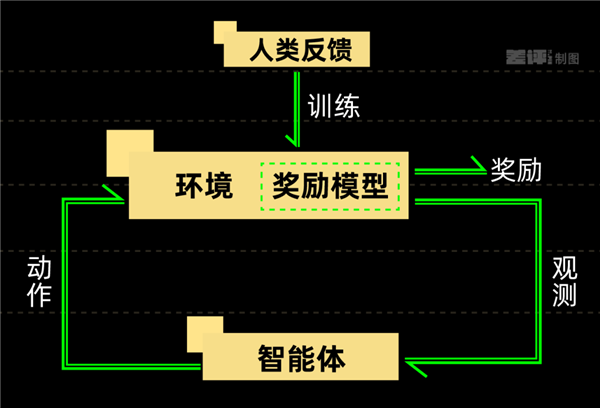

人工智能模型训练的最新趋势显示,强化学习(RL)已成为提升模型能力的关键驱动力。DeepSeek 的 R1 模型以及 OpenAI、Anthropic、Google、阿里 Qwen 和 Grok 等行业巨头都在大力投入强化学习技术的研发。这一方法将模型置于实际应用场景中进行“实战”,通过奖励与惩罚机制来优化其表现,例如在代码生成任务中,模型需要实际运行代码并验证结果的正确性。

在这一过程中,CPU 扮演着至关重要的角色。它负责模型训练的“演习”环节,为模型提供训练环境、数据支持以及结果评估。CPU 的强大性能直接影响着强化学习训练的效率和模型的学习效果,使其成为 AI 模型最严苛的“导师”。

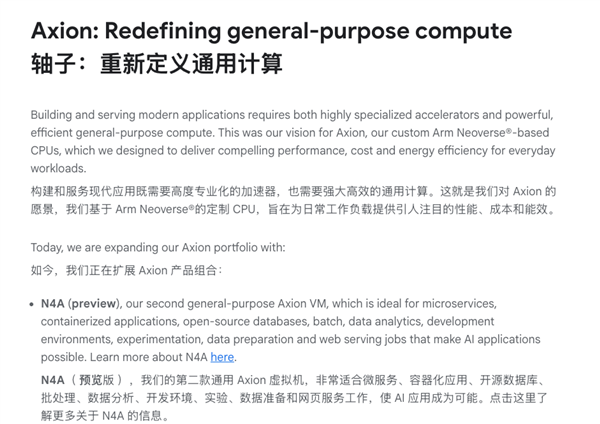

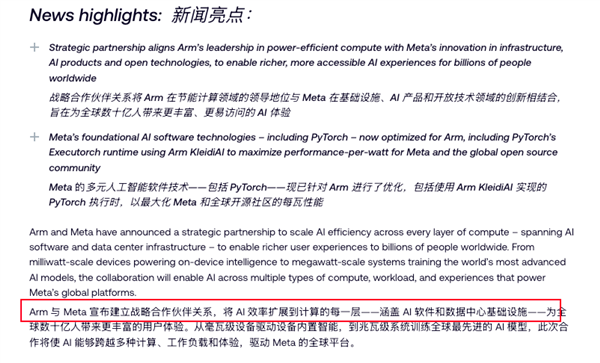

为满足日益增长的 CPU 需求,各大 AI 公司纷纷采取行动。除了直接向英特尔等传统 CPU 制造商采购外,谷歌已开始自主研发 CPU Axion,而 Meta 则与 Arm 展开合作,共同开发新一代处理器。这种对高性能 CPU 的争夺,也反映了 AI 训练对算力基础设施提出的新要求。

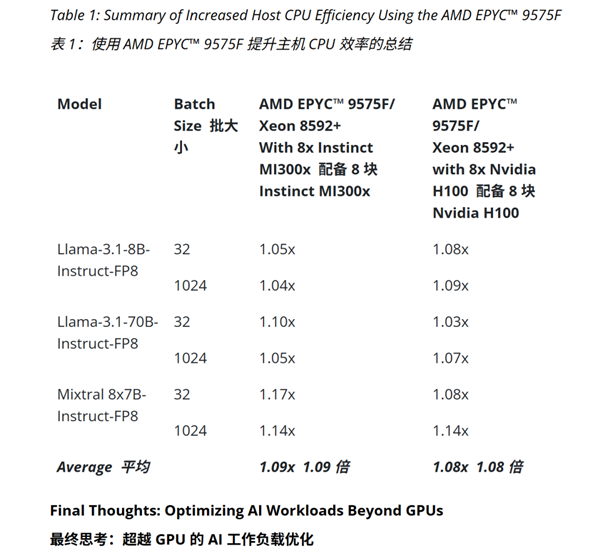

一项有趣的观察是,在数据中心中,增加对高性能 CPU 的投入,反而可能带来整体成本的节约。这是因为 CPU 在 AI 推理过程中承担着前置的繁重任务,包括请求处理、数据分配、模型加载及 KV 缓存更新等。如果 CPU 性能不足,将导致 GPU 资源闲置,延长任务执行时间,从而增加能源消耗和电费支出。相反,采用更强大的 CPU 可以显著提高 GPU 的工作效率,虽然 CPU 本身功耗可能增加,但整体上能缩短运算周期,实现更优的能源利用率。AMD 的实验数据显示,使用更优化的 CPU 配置,能在提升 0.8% 功耗的同时,实现 8% 的效率增长,这使得数据中心“越贵越便宜”的效益成为可能。

行业观察:AI 算力新格局下的 CPU 角色演变

CPU 在 AI 算力生态中的角色正在经历深刻的重塑。传统上,GPU 凭借其并行计算能力在深度学习训练中占据主导地位。然而,随着 AI 模型复杂度提升,尤其是强化学习等更注重决策逻辑和交互式学习方法的兴起,CPU 的作用愈发凸显。CPU 不仅是执行指令、管理系统资源的“大脑”,更成为 AI 模型在复杂环境中进行“思考”和“决策”的关键协作者。在 AI Agent 和更高级的强化学习应用场景中,CPU 的地位将更加稳固,成为支撑 AI 发展不可或缺的基础设施。

这一变化对 CPU 制造商而言意味着巨大的机遇。英特尔、AMD 以及有意进入 AI 算力领域的英伟达,都将在这一波 AI 浪潮中分得一杯羹。然而,对于普通消费者而言,显卡和 CPU 等硬件成本的上升,无疑增加了组建高性能个人电脑的门槛,尤其对于游戏玩家而言,这意味着未来升级设备的成本将显著提高。