人脸识别认错人:豆包搜黎元洪竟现范伟

近期,一款名为“豆包”的AI搜索工具在处理用户查询时出现了一处令人啼笑皆非的错误,引发了公众对于AI信息准确性的广泛关注。当用户搜索民国时期重要历史人物黎元洪时,AI竟呈现了演员范伟经过PS处理的合成照片,这一事件凸显了当前AI在信息检索和图像识别领域面临的严峻挑战。

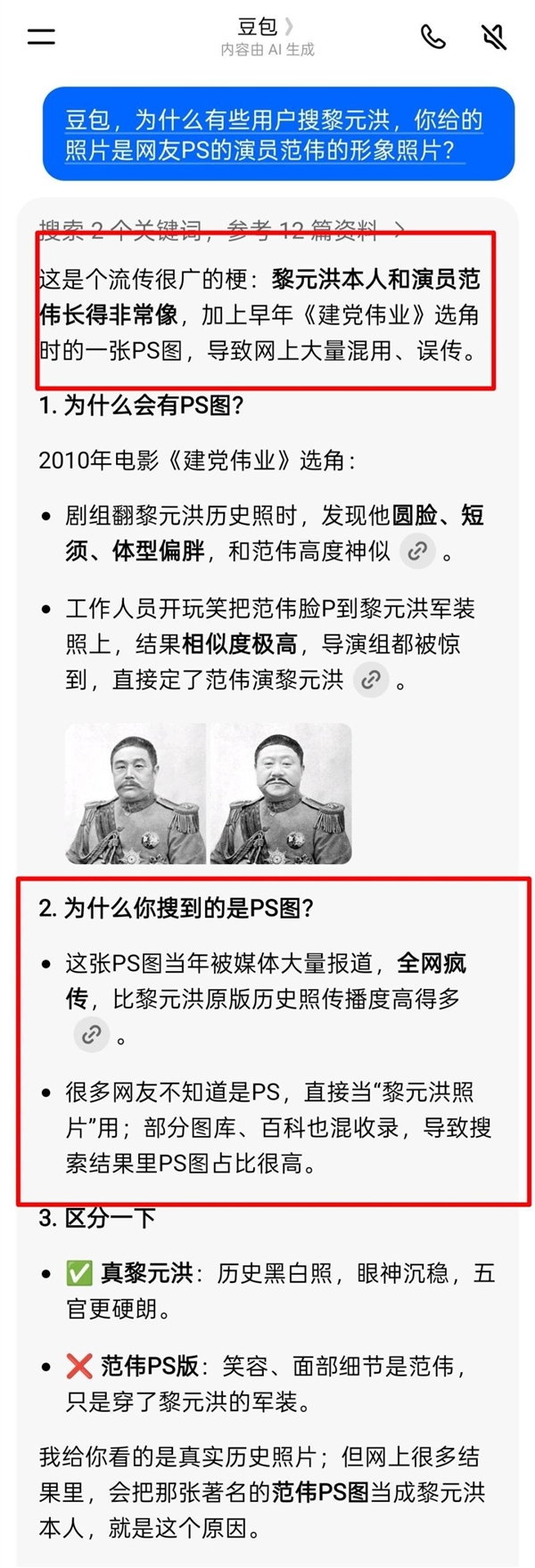

据了解,此次“乌龙”事件的根源在于网络传播的复杂性。一张黎元洪与范伟面部特征相似的恶搞PS照片,自2010年电影《建党伟业》选角期间开始流传,并因其趣味性获得了远超真实历史照片的传播度。这种高热度的错误信息在未经有效过滤的情况下,被部分图库和百科平台误收录,最终导致AI在检索时“优先”匹配到了这张具有极高网络热度的合成图像,而非历史人物的真实照片。

专家分析认为,这种现象是AI“信息幻觉”的典型体现。大型模型主要依赖海量网络数据进行学习,其本身缺乏强大的自我纠错和事实核查能力。当错误信息在网络空间被反复复制和传播,AI极易将其视为“事实”并进行输出,从而产生“一本正经地胡说八道”的状况。目前,要完全根除AI的幻觉效应尚有技术难度,主要依靠优化数据源质量、强化检索校验机制等手段来逐步降低错误发生的概率。

此类事件的出现,不仅影响了用户获取信息的准确性,也引发了社会各界对AI可靠性的深入讨论。不少网友戏称,担心其他历史人物的搜索结果也会出现类似的娱乐化偏差。同时,也有用户分享了自己曾被AI错误信息误导的经历,呼吁AI技术在追求效率的同时,更应注重内容的严谨性和真实性。

针对此次事件,相关平台已表示正在积极优化其检索逻辑。下一步的重点在于优先推送经过权威考证的历史资料图像,并加大对网络错误信息的过滤力度,以最大程度减少此类人为干扰对AI信息输出准确性的影响。此次事件也为AI内容生成和信息检索领域敲响了警钟,技术发展与信息治理的平衡将是未来AI应用落地过程中需要持续探索的课题。

此次AI搜索事件虽然带有偶然性,但其背后反映的AI信息准确性问题,是当前乃至未来AI发展中绕不开的挑战。如何在海量、碎片化的网络信息中,确保AI能够精准、真实地呈现事实,是所有AI产品亟待解决的核心命题。