阿里通义千问Qwen3.6-27B开源,编程实力显著提升

阿里云通义千问团队于4月22日宣布,其开源模型家族迎来重要成员——270亿参数的稠密多模态模型Qwen3.6-27B。此次更新不仅丰富了Qwen系列的产品线,更在保持稠密模型架构优势的同时,在智能体编程和多模态理解能力上实现了显著的进化。

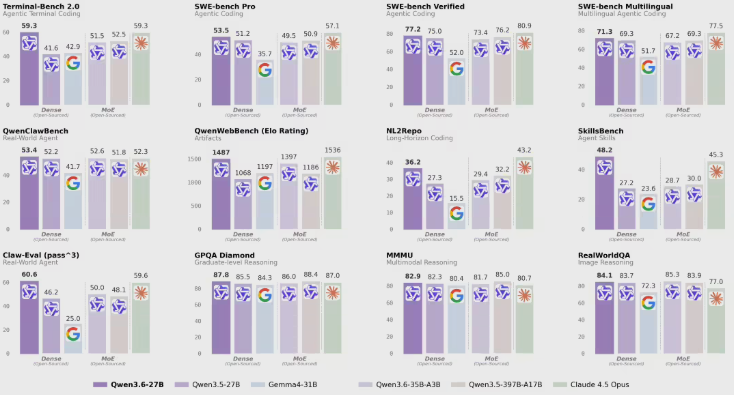

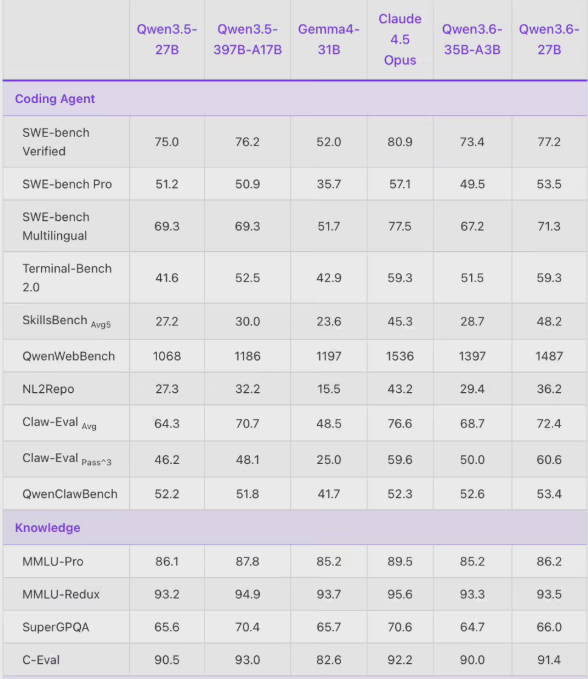

Qwen3.6-27B在性能上展现了“以小博大”的惊人实力,其270亿参数的规模在多项编程基准测试中,已全面超越了此前总参数量高达3970亿的MoE(混合专家模型)Qwen3.5-397B-A17B。具体而言,该模型在衡量代码修复能力的SWE-bench Verified测试中获得了77.2的高分,并在SkillsBench等推理任务上取得了显著进步。这意味着开发者在无需复杂MoE路由的情况下,也能获得旗舰级的编程辅助体验,大大降低了部署和使用的门槛。

在多模态处理能力方面,Qwen3.6-27B同样表现出色,原生支持图像、视频与文本的混合输入。这使得它能够胜任视觉推理、深度文档理解以及交互式视觉问答等多种应用场景。官方数据显示,其多模态处理能力已达到与更高参数级别模型(如Qwen3.6-35B-A3B)一致的水平,能够确保在处理复杂多模态任务时依然保持高精度的输出。

为加速技术落地,Qwen3.6-27B的开源权重已同步上线Hugging Face和ModelScope(魔搭)两大开发者社区,支持本地化部署。后续,阿里云百炼平台也将提供API调用服务,并特别保留了“preserve_thinking”功能,以支持智能体任务中的思维链回溯。此外,该模型已实现与Claude Code、Qwen Code等主流编程助手的无缝集成,旨在为全球开发者构建一个更精准、更具上下文感知能力的编码辅助环境。

Qwen3.6-27B作为一款稠密多模态模型,其核心优势在于以相对较小的参数规模实现了强大的编程辅助和多模态理解能力。这使得它在部署上更加灵活,特别适合对资源有一定限制但又需要高性能AI能力的应用场景。其支持混合输入形式,能够处理图像、视频等非文本信息,为开发更智能化的交互式应用提供了更多可能性。同时,其深度适配开发者工作流的设计,降低了AI技术应用的门槛。

此次Qwen3.6-27B的发布,标志着开源大模型在保持高效稠密架构的同时,在编程能力和多模态理解上取得了新的突破。对于追求高性能与易用性平衡的开发者而言,这无疑是一个值得关注的有力工具。