智能体藏恶意代码,养龙虾有风险

AI 智能体安全隐患浮现:热门开源项目“龙虾”技能包暗藏恶意代码

近期,行业内高度关注的开源 AI 智能体“龙虾”(OpenClaw)部分技能包被发现存在安全漏洞,成为新型病毒传播的潜在渠道,对用户设备及财产安全构成了严峻威胁。这一事件再次敲响了 AI 技术应用安全性的警钟,凸显了当前 AI 生态系统在快速发展中面临的挑战。

“龙虾”智能体因其支持本地部署和自动执行任务的特性,在开发者和用户群体中获得了广泛的认可。然而,其生态系统的安全短板也逐渐显现。供应链的可靠性、自定义接口的安全性以及技能包的审核机制,都可能成为不法分子植入恶意代码的突破口。

不法分子正利用这一漏洞,通过仿冒合规的技能包,将恶意代码悄然植入。一旦用户在不知情的情况下安装并调用这些被污染的技能包,便可能在后台静默下载木马程序。这些木马能够窃取用户的账号密码、金融信息等高度敏感的个人数据,甚至可能将智能体本身转化为攻击跳板,进而入侵用户的内部网络或其他联网设备,造成难以估量的损失。

据国家计算机病毒应急处理中心高级工程师杜振华介绍,这些恶意技能包的运行过程高度隐蔽,能在用户不知不觉中窃取隐私并将其外传,极易导致严重的信息泄露和财产损失。多家安全研究机构已多次发布相关预警,呼吁用户加强对 AI 智能体应用源头的防护措施,并强化网络边界的安全管控。

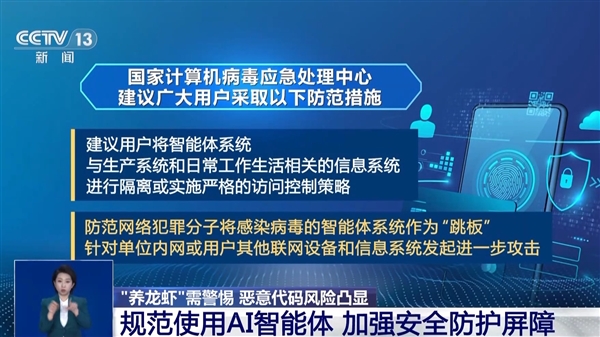

针对这一日益突出的安全问题,官方已发布了一系列明确的防范指引,旨在帮助用户降低风险:

- 严禁输入敏感信息:用户应避免向 AI 智能体提交包括密码、个人隐私信息在内的任何敏感数据。

- 限制高风险操作:应禁止智能体执行可能带来高风险或不可逆后果的操作,并严格收紧其操作权限。

- 代码审计与验证:在安装任何技能包之前,务必对代码、链接及相关功能进行仔细审计,以排除未知后门和潜在风险。

- 系统隔离与访问控制:将 AI 智能体运行的系统与生产环境、日常办公及生活系统进行物理或逻辑上的隔离,并严格控制其访问权限。

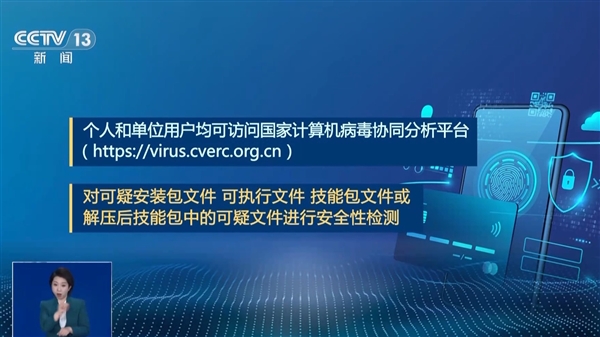

- 利用官方检测平台:用户可以利用国家计算机病毒协同分析平台等官方工具,对可疑的安装包进行安全检测。

此次由央视报道的关于“龙虾”智能体安全事件的预警,再次提醒广大用户,在享受 AI 智能体带来的效率提升的同时,其潜在的安全风险绝不容忽视。用户应本着审慎的态度,规范使用 AI 工具,并时刻关注并管理其权限设置,以避免因盲目应用而导致设备被恶意控制、个人隐私被窃取的严重后果。

AI 智能体的普及是技术进步的必然趋势,但伴随而来的安全挑战也日益复杂化。此次事件揭示了开源生态系统中供应链安全的重要性,以及用户在安全防护中的主体责任。未来,构建一个更加安全、可信赖的 AI 应用环境,需要开发者、平台提供商以及用户三方的共同努力和持续投入。